15/07/2024

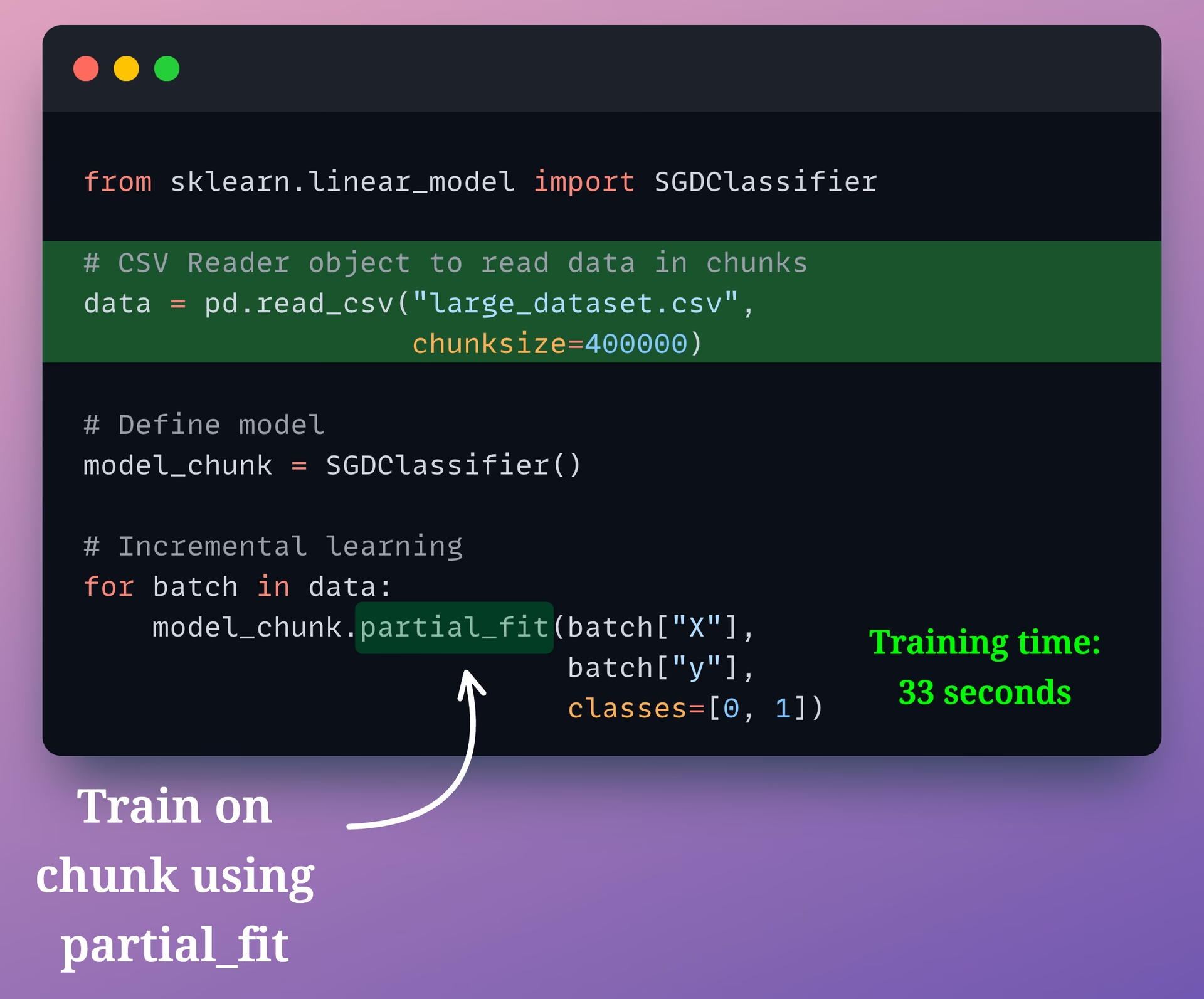

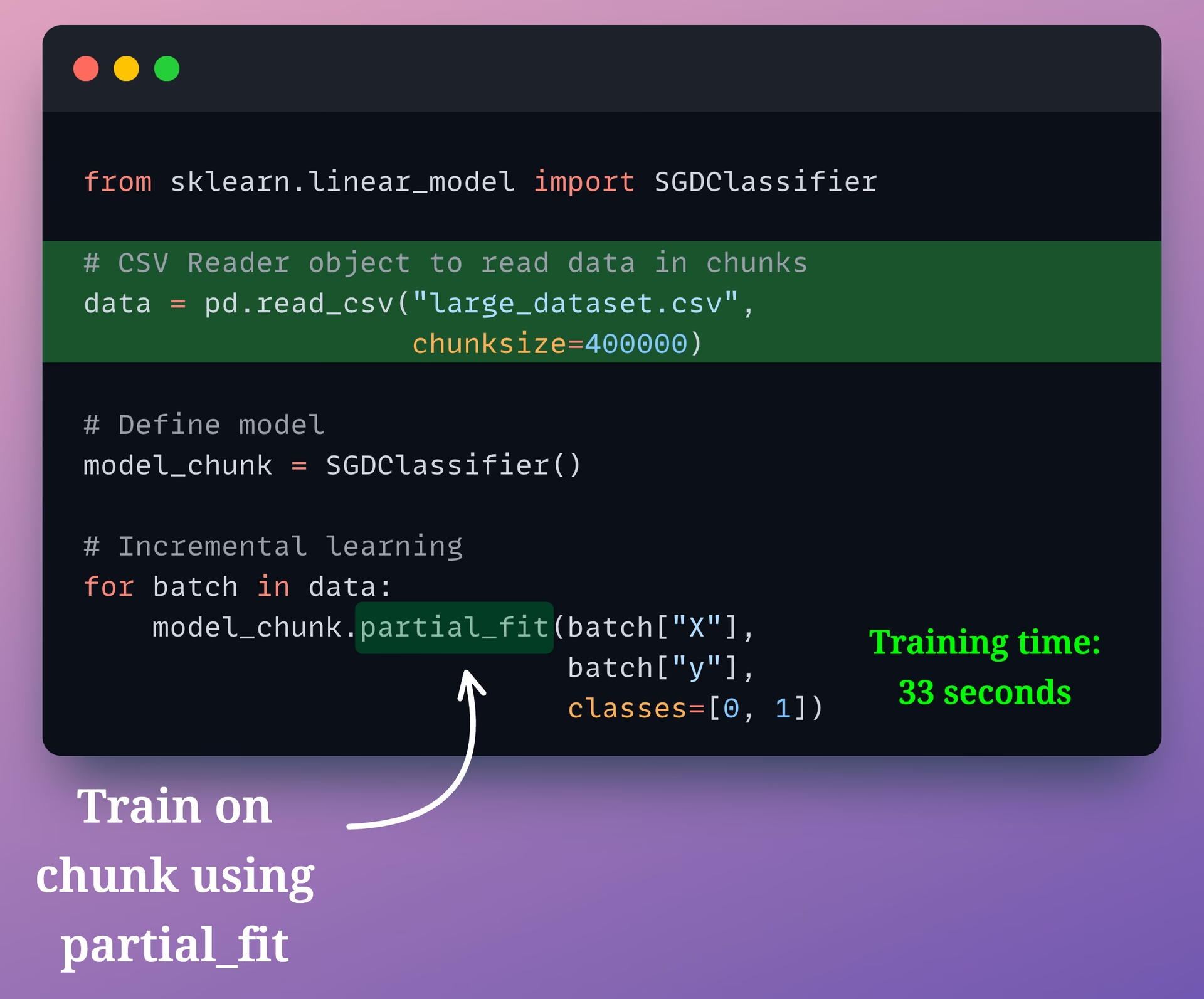

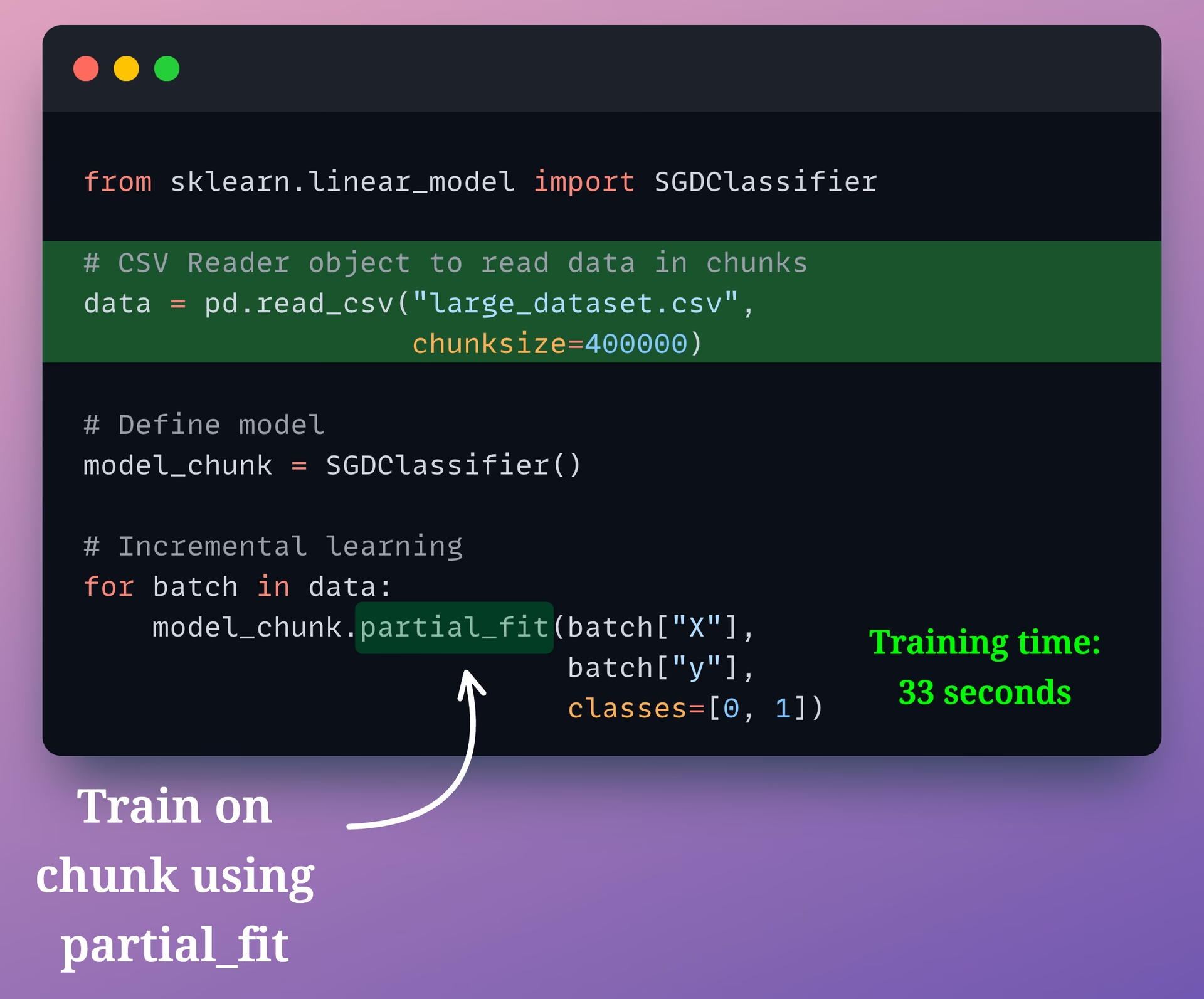

În era datelor masive, o provocare recurentă pentru practicienii machine learning este gestionarea seturilor de date care depășesc capacitatea memoriei RAM a unui sistem. Metodele tradiționale de antrenament, care necesită încărcarea întregului set de date deodată (așa-numitul antrenament 'in-memory'), devin rapid impracticabile. Aici intervine conceptul de învățare incrementală sau 'out-of-core', o abordare revoluționară care permite modelelor să învețe pe rând, din porțiuni mici de date. Un instrument esențial pentru acest tip de învățare este metoda partial_fit, disponibilă în diverse algoritmi din ecosistemul machine learning, inclusiv în puternicul SGDClassifier.

Acest articol explorează în detaliu funcționalitatea partial_fit, modul în care SGDClassifier o utilizează pentru a facilita învățarea pe date masive și cum o poți implementa eficient în proiectele tale. Vom compara partial_fit cu metoda clasică fit, vom discuta despre provocările și soluțiile specifice învățării out-of-core și vom oferi sfaturi practice pentru optimizarea procesului.

- Ce este Metoda partial_fit?

- Învățarea Out-of-Core: Scalarea cu Instanțe

- SGDClassifier: Un Algoritm Cheie pentru Învățare Incrementală

- partial_fit vs. fit: O Comparație Detaliată

- Alți Algoritmi cu Capacitate partial_fit

- Provocări și Considerații în Utilizarea partial_fit

- Întrebări Frecvente (FAQ)

- Concluzie

Ce este Metoda partial_fit?

Metoda partial_fit este o funcționalitate cheie pentru algoritmii de învățare automată care trebuie să proceseze date în mod incremental, adică pe 'mini-batch-uri' sau 'online'. Spre deosebire de metoda fit, care necesită întregul set de date de antrenament disponibil dintr-o dată, partial_fit permite modelului să învețe din subseturi de date, actualizându-și parametrii cu fiecare iterație. Acest lucru este extrem de util în scenarii unde:

- Setul de date este prea mare pentru a încăpea în memoria RAM.

- Datele sosesc continuu (stream de date) și modelul trebuie să se adapteze în timp real.

- Este necesară o actualizare rapidă a modelului pe baza datelor noi.

Pentru SGDClassifier, un apel la partial_fit echivalează cu efectuarea unei singure epoci de antrenament pe subsetul de date furnizat (max_iter = 1 intern). Este important de reținut că, atunci când se utilizează partial_fit, responsabilitatea pentru gestionarea convergenței, a opririi anticipate (early stopping) și a ajustării ratei de învățare (learning rate) cade în sarcina utilizatorului, deoarece metoda nu garantează atingerea unui minim al funcției de cost după un singur apel.

Învățarea Out-of-Core: Scalarea cu Instanțe

Out-of-core learning (sau învățare 'din memorie externă') este o tehnică utilizată pentru a antrena modele pe seturi de date care nu pot fi stocate în întregime în memoria principală a computerului (RAM). Un sistem eficient pentru învățarea out-of-core implică trei componente esențiale:

- Un mecanism de streaming al instanțelor: Acesta poate fi un cititor care preia date din fișiere de pe hard disk, dintr-o bază de date, dintr-un flux de rețea etc. Detaliile implementării acestui mecanism depășesc scopul acestei discuții, dar ideea este de a furniza date în bucăți gestionabile.

- O modalitate de extragere a caracteristicilor din instanțe: Când lucrezi cu date care necesită vectorizare și unde setul de caracteristici sau valori nu este cunoscut în avans (de exemplu, clasificarea textului unde pot apărea termeni noi), trebuie să acorzi o atenție deosebită. Abordările comune includ utilizarea vectorizatorilor cu stare, dacă se pot face mai multe treceri peste date, sau utilizarea 'trucului de hashing' (hashing trick) implementat de clase precum

sklearn.feature_extraction.FeatureHasherpentru date cu variabile categorice sausklearn.feature_extraction.text.HashingVectorizerpentru documente text. Acestea permit o extracție de caracteristici fără stare, eficientă pentru fluxuri de date. - Un algoritm incremental: Aceasta este componenta unde

partial_fitstrălucește. Nu toți algoritmii pot învăța incremental (adică fără a vedea toate instanțele deodată), dar toți estimatorii care implementează API-ulpartial_fitsunt candidați potriviți. Capacitatea de a învăța incremental dintr-un mini-batch de instanțe este esențială pentru învățarea out-of-core, deoarece garantează că la un moment dat va exista doar o cantitate mică de instanțe în memoria principală. Alegerea unei dimensiuni optime pentru mini-batch, care echilibrează relevanța și amprenta de memorie, poate necesita o anumită ajustare.

SGDClassifier: Un Algoritm Cheie pentru Învățare Incrementală

SGDClassifier este un clasificator liniar care utilizează descendentul stocastic al gradientului (Stochastic Gradient Descent – SGD) pentru antrenament. Este o alegere excelentă pentru învățarea incrementală datorită naturii sale algoritmice, care actualizează modelul pe bază de eșantion cu eșantion sau mini-batch cu mini-batch. Poate implementa diverse modele liniare, cum ar fi SVM (Linear Support Vector Machine) sau regresia logistică, în funcție de funcția de pierdere (loss function) aleasă.

Câteva aspecte cheie ale SGDClassifier relevante pentru partial_fit includ:

- Funcția de pierdere (

loss): Determină tipul de model. Opțiuni populare includ'hinge'(pentru SVM liniar),'log_loss'(pentru regresie logistică) și'modified_huber'(o pierdere netedă, tolerantă la valori aberante, care oferă și estimări de probabilitate). - Regularizarea (

penalty): Adaugă un termen de penalizare funcției de pierdere pentru a preveni supra-antrenarea. Opțiunile sunt'l1','l2'(implicit) și'elasticnet'. Parametrulalphacontrolează intensitatea regularizării. - Rata de învățare (

learning_rate): Definește modul în care modelul își ajustează greutățile. Opțiunile includ'optimal'(implicit, bazat pe o euristică),'constant','invscaling'și'adaptive'.eta0este rata de învățare inițială pentru anumite scheme. warm_start: Un parametru crucial. Când este setat laTrue, fiecare apel ulterior lafitsaupartial_fitva reutiliza soluția (coeficienții și intercepția) din apelul anterior ca inițializare. Acest lucru este fundamental pentrupartial_fit, deoarece permite modelului să își continue antrenamentul de unde a rămas, fără a reseta parametrii. Dacăwarm_startesteFalse(implicit), fiecare apel lafitsaupartial_fitar șterge soluția anterioară.max_iter: Atenție! Acest parametru definește numărul maxim de treceri (epoci) peste datele de antrenament și afectează doar metodafit, nu șipartial_fit. Pentrupartial_fit, fiecare apel este o singură epocă.

partial_fit vs. fit: O Comparație Detaliată

Înțelegerea diferențelor dintre partial_fit și fit este esențială pentru a alege metoda potrivită pentru problema ta. Iată o comparație:

| Caracteristică | fit | partial_fit |

|---|---|---|

| Date necesare | Întregul set de date deodată | Subseturi (mini-batch-uri) de date |

| Utilizare memorie | Înaltă (poate duce la erori de memorie pentru date mari) | Redusă (doar un mini-batch la un moment dat) |

| Aplicații ideale | Seturi de date mici-medii, antrenament unic | Seturi de date masive (out-of-core), streaming de date, actualizări continue |

| Control antrenament | Automat (gestionează epoci, convergență, early stopping) | Manual (utilizatorul gestionează epoci, convergență, early stopping) |

Parametru max_iter | Relevant, controlează numărul de epoci | Nu este relevant (fiecare apel este o epocă) |

Parametru warm_start | Util pentru a relua antrenamentul, dar resetarea contorului de învățare | Crucial pentru a menține starea modelului și a continua antrenamentul |

Gestionare classes | Detectează automat toate clasele | Necesită specificarea tuturor claselor posibile la primul apel (classes=np.unique(y_all)) |

Alți Algoritmi cu Capacitate partial_fit

Pe lângă SGDClassifier, scikit-learn oferă o serie de alți estimatori care implementează API-ul partial_fit și sunt potriviți pentru învățarea incrementală:

- Clasificare:

sklearn.naive_bayes.MultinomialNBsklearn.naive_bayes.BernoulliNBsklearn.linear_model.Perceptronsklearn.linear_model.PassiveAggressiveClassifier

- Regresie:

sklearn.linear_model.SGDRegressorsklearn.linear_model.PassiveAggressiveRegressor

- Clustering:

sklearn.cluster.MiniBatchKMeans

- Decompunere / Extracție de caracteristici:

sklearn.decomposition.MiniBatchDictionaryLearning

Provocări și Considerații în Utilizarea partial_fit

Deși partial_fit este o soluție puternică, există câteva aspecte de care trebuie să ții cont pentru a asigura o implementare corectă și eficientă:

Gestionarea Claselor Noi

Un aspect important, mai ales pentru clasificatori, este gestionarea claselor țintă. Dacă rutina de extragere a caracteristicilor fără stare poate face față atributelor noi/nevăzute, algoritmul de învățare incrementală în sine poate fi incapabil să gestioneze clase țintă noi/nevăzute. În acest caz, este absolut necesar să transmiți toate clasele posibile către primul apel partial_fit folosind parametrul classes=. De exemplu, dacă știi că setul tău de date complet va avea clasele 0, 1 și 2, chiar dacă primul tău mini-batch conține doar 0 și 1, ar trebui să apelezi partial_fit(X_batch, y_batch, classes=np.array([0, 1, 2])). Acest lucru pregătește modelul pentru a întâlni toate clasele anticipate.

Robustețea Algoritmilor

Nu toți algoritmii cu partial_fit pun aceeași importanță pe fiecare exemplu în timp. De exemplu:

Perceptron: Este încă sensibil la exemplele etichetate incorect chiar și după multe exemple, deoarece nu are o rată de învățare care să scadă în timp.- Familiile

SGD*șiPassiveAggressive*: Sunt mai robuste la acest tip de artefacte. Cu toate acestea, ele tind să acorde mai puțină importanță exemplelor remarcabil diferite, dar etichetate corect, atunci când acestea apar târziu în flux, deoarece rata lor de învățare scade în timp. Această scădere a ratei de învățare este de obicei o caracteristică de design pentru a asigura convergența.

Alegerea algoritmului potrivit depinde de sensibilitatea dorită la erori și de modul în care dorești ca modelul să se adapteze la noi informații în timp.

Dimensiunea Mini-Batch-ului

Alegerea unei dimensiuni bune pentru mini-batch este un compromis între relevanța statistică (mini-batch-uri mai mari pot oferi o estimare mai bună a gradientului) și amprenta de memorie (mini-batch-uri mai mici necesită mai puțină RAM). O dimensiune prea mică poate duce la o convergență lentă sau oscilații, în timp ce o dimensiune prea mare poate anula beneficiile învățării out-of-core. Ajustarea acestei dimensiuni este adesea un proces de tuning.

Întrebări Frecvente (FAQ)

Când ar trebui să folosesc partial_fit?

Ar trebui să folosești partial_fit atunci când setul tău de date este prea mare pentru a încăpea în memoria RAM, când datele sosesc continuu (învățare online sau streaming) sau când vrei să antrenezi un model pe etape, cu posibilitatea de a relua oricând antrenamentul pe noi date, fără a reîncepe de la zero.

Este partial_fit mai rapid decât fit?

Nu neapărat. Un singur apel la partial_fit procesează un subset de date și este rapid. Însă, pentru a atinge performanțe comparabile cu fit pe întregul set de date, va trebui să apelezi partial_fit de mai multe ori, într-o buclă, gestionând manual epocile. Timpul total de antrenament poate fi similar sau chiar mai mare, mai ales dacă I/O pentru citirea datelor în batch-uri devine un blocaj. Avantajul principal este capacitatea de a lucra cu date masive și de a permite antrenamentul continuu, nu neapărat viteza absolută.

Cum gestionez datele noi care apar după antrenarea inițială?

Pentru a gestiona datele noi, poți continua să apelezi partial_fit pe noile mini-batch-uri de date. Asigură-te că instanța modelului are warm_start=True setat pentru a reutiliza soluția existentă ca inițializare. Aceasta permite modelului să se adapteze la noile informații fără a uita ceea ce a învățat anterior.

Ce înseamnă warm_start=True pentru partial_fit?

warm_start=True indică modelului să reutilizeze parametrii (coeficienții și intercepția) învățați în apelurile anterioare ale metodelor fit sau partial_fit ca punct de plecare pentru antrenamentul curent. Fără warm_start=True, fiecare apel ar reseta modelul, ceea ce ar anula beneficiile învățării incrementale.

Pot folosi early stopping cu partial_fit?

Da, dar trebuie să implementezi logica de early stopping manual. Parametrii early_stopping, validation_fraction, n_iter_no_change și tol din constructorul SGDClassifier sunt aplicați în contextul metodei fit. Atunci când folosești partial_fit, tu ești responsabil să monitorizezi performanța modelului (de exemplu, pe un set de validare separat) după fiecare mini-batch sau după un anumit număr de mini-batch-uri și să oprești antrenamentul dacă performanța nu se îmbunătățește conform criteriilor tale.

Concluzie

Metoda partial_fit din SGDClassifier și alți estimatori incrementală este o piatră de temelie pentru machine learning-ul modern, care se confruntă cu volume tot mai mari de date. Prin adoptarea acestei abordări, dezvoltatorii pot construi sisteme de învățare automată robuste și scalabile, capabile să proceseze informații în flux continuu și să se adapteze dinamic la noi tendințe, depășind limitările memoriei fizice. Înțelegerea și aplicarea corectă a partial_fit deschide noi orizonturi pentru soluții inteligente în diverse domenii, de la analiză financiară la procesarea limbajului natural și sisteme de recomandare.

Dacă vrei să descoperi și alte articole similare cu partial_fit: Antrenament Incremental Eficient, poți vizita categoria Fitness.