18/09/2023

Antrenarea unui model de învățare automată este un proces fundamental în dezvoltarea soluțiilor de inteligență artificială. În ecosistemul TensorFlow și Keras, funcția tf.keras.Model.fit este piatra de temelie a acestui proces, oferind o interfață de nivel înalt pentru a simplifica și eficientiza antrenamentul.

tf.keras.Model.fit: Inima Antrenamentului Modelelor Keras

Funcția tf.keras.Model.fit este un component crucial al API-ului TensorFlow Keras, concepută pentru a antrena modele de învățare automată pe date. Această funcție încapsulează întregul proces de antrenament, incluzând preprocesarea datelor, calculul gradientului, actualizarea parametrilor modelului și urmărirea metricilor. Oferă o interfață de nivel înalt care simplifică procesul de antrenament, permițând dezvoltatorilor să se concentreze pe arhitectura modelului și pregătirea datelor.

Parametri Cheie ai fit()

Funcția fit acceptă o varietate de argumente care controlează procesul de antrenament. Iată câțiva dintre cei mai importanți:

xșiy: Datele de intrare și țintele (etichetele) pentru antrenament. Acestea pot fi array-uri NumPy, tensori TensorFlow sau obiectetf.data.Dataset.epochs: Numărul de epoci, adică de câte ori întregul set de date de antrenament va fi parcurs. Fiecare epocă reprezintă o iterație completă peste date.batch_size: Numărul de eșantioane care vor fi propagate prin rețea într-o singură iterație înainte de actualizarea greutăților. O dimensiune a lotului bine aleasă poate influența semnificativ viteza și stabilitatea antrenamentului.validation_data: Un set de date separat (de obicei o tuplă(x_val, y_val)sau untf.data.Dataset) utilizat pentru evaluarea performanței modelului în timpul antrenamentului. Aceasta ajută la detectarea supra-antrenării (overfitting).callbacks: O listă de obiecte callback care pot fi utilizate pentru a monitoriza și modifica procesul de antrenament (vom discuta mai multe despre ele în secțiunea de antrenament).shuffle: Un boolean care indică dacă datele de antrenament trebuie amestecate înainte de fiecare epocă. Recomandat pentru a asigura o generalizare bună.

Pregătirea Datelor pentru Antrenament

Pregătirea datelor este un pas crucial în construirea modelelor de învățare automată eficiente și precise. TensorFlow oferă utilitare și structuri de date pentru a facilita preprocesarea și încărcarea datelor. Abordarea cea mai comună este crearea obiectelor tf.data.Dataset, care reprezintă secvențe de elemente pe care puteți efectua transformări și operații de preprocesare.

Iată un exemplu de încărcare și preprocesare a datelor folosind API-ul Dataset din TensorFlow:

import tensorflow as tf # Încărcați date din array-uri numpy (sau alte formate) x_train, y_train = load_data('train') x_val, y_val = load_data('val') # Creați seturi de date train_dataset = tf.data.Dataset.from_tensor_slices((x_train, y_train)) val_dataset = tf.data.Dataset.from_tensor_slices((x_val, y_val)) # Preprocesați datele train_dataset = train_dataset.shuffle(buffer_size=1024).batch(32) val_dataset = val_dataset.batch(32)În acest exemplu, încărcăm mai întâi datele de antrenament și validare din surse externe. Apoi, creăm obiecte tf.data.Dataset din acești tensori folosind metoda from_tensor_slices. Aceasta ne permite să tratăm datele ca o secvență de perechi (intrare, etichetă). Apoi, aplicăm operațiuni de preprocesare, cum ar fi amestecarea datelor de antrenament și împachetarea ambelor seturi de date în loturi de 32 de eșantioane. Alte transformări comune includ normalizarea, augmentarea și parsarea formatelor complexe de date.

API-ul Dataset din TensorFlow oferă mai multe avantaje:

- Încărcare și preprocesare eficientă a datelor.

- Lotizare și prefetch-ing automat pentru performanță îmbunătățită.

- Suport pentru pipeline-uri și transformări complexe de date.

- Integrare perfectă cu funcțiile de antrenament a modelului din TensorFlow (e.g.,

model.fit).

Definirea Arhitecturii Modelului

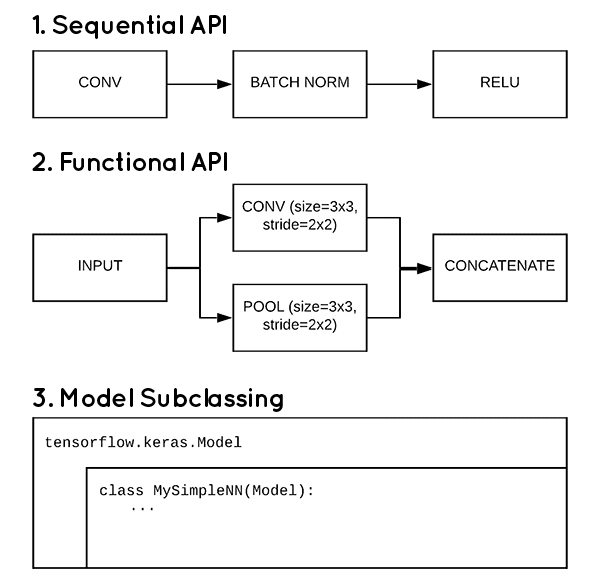

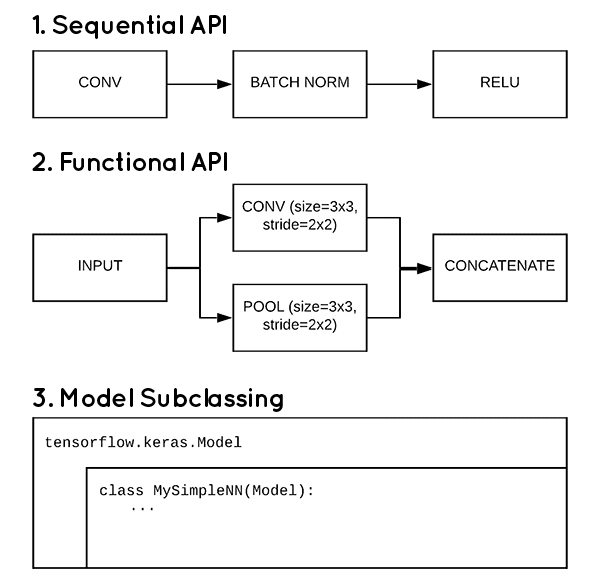

Definirea arhitecturii modelului este un pas esențial în construirea modelelor de învățare automată cu TensorFlow. Modulul tf.keras.models oferă mai multe clase și utilitare pentru construirea arhitecturilor de rețele neuronale, incluzând modele secvențiale, modele funcționale și subclasarea personalizată a modelului.

Modele Secvențiale (Sequential)

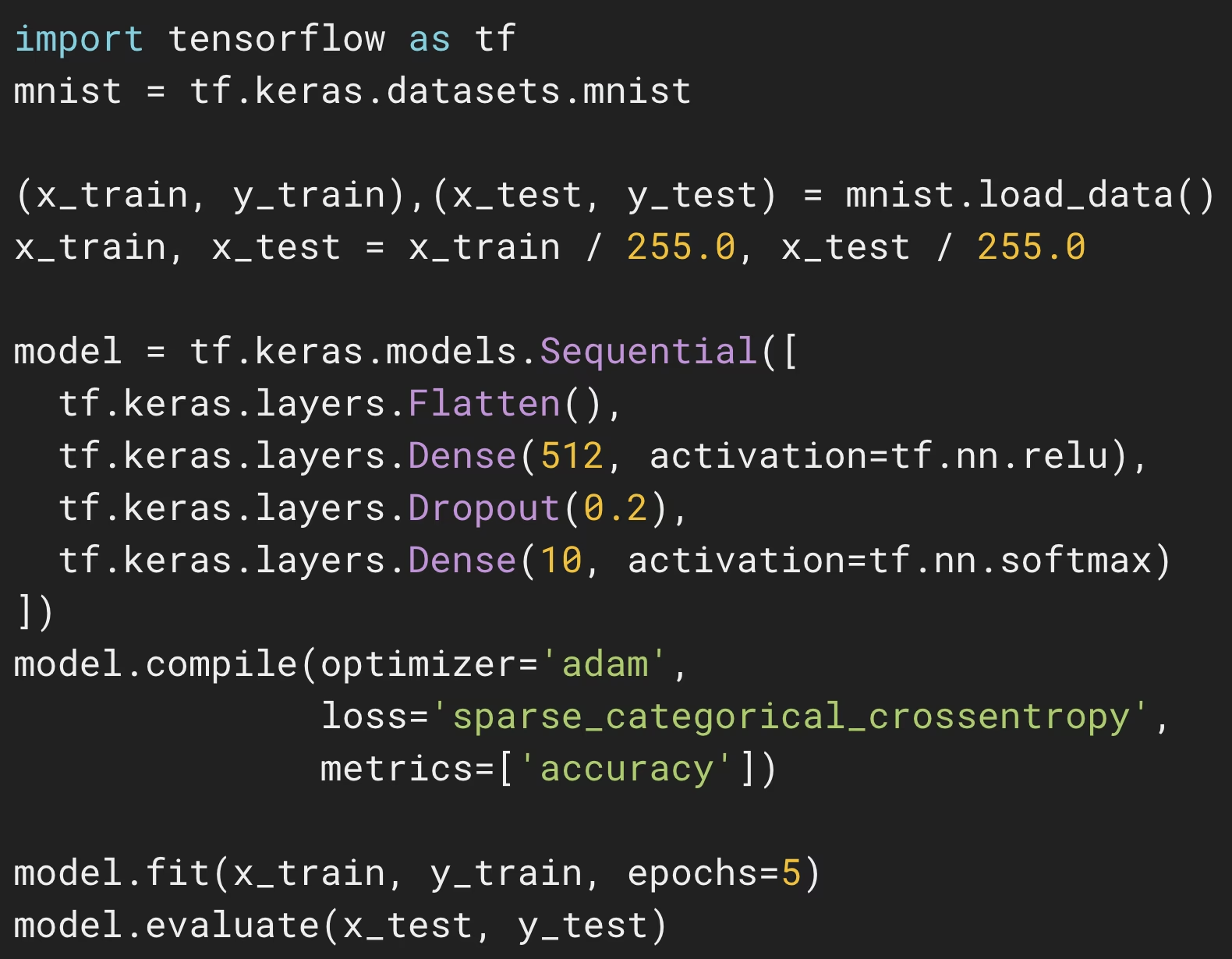

Clasa tf.keras.models.Sequential este o stivă liniară de straturi, potrivită pentru arhitecturi simple, cum ar fi rețelele feed-forward sau rețelele neuronale convoluționale. Sunt ideale pentru cazurile în care fiecare strat are exact o intrare și o ieșire, și straturile sunt conectate în ordine strictă.

from tensorflow.keras.models import Sequential from tensorflow.keras.layers import Dense, Dropout, Flatten model_sequential = Sequential([ Flatten(input_shape=(28, 28)), Dense(128, activation='relu'), Dropout(0.2), Dense(10, activation='softmax') ])În acest exemplu, creăm un model secvențial cu un strat de aplatizare, urmat de două straturi Dense cu activări ReLU și softmax, respectiv. Un strat de dropout este de asemenea inclus pentru regularizare.

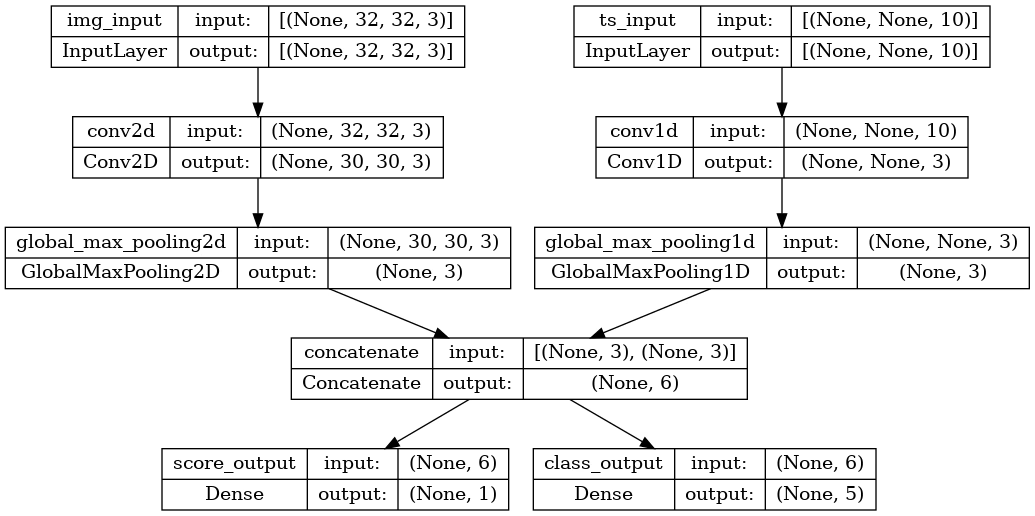

Modele Funcționale (Functional API)

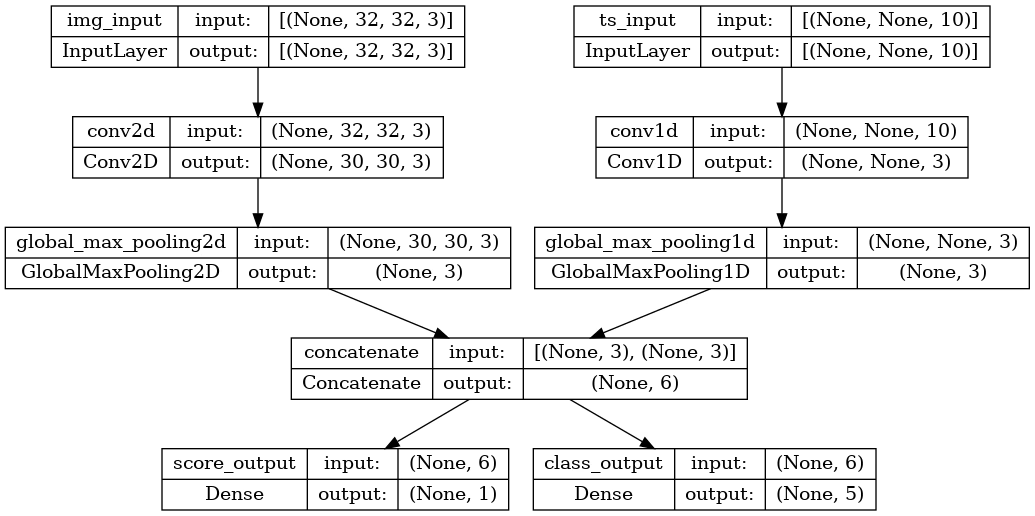

Pentru arhitecturi mai complexe, cum ar fi modelele cu straturi partajate sau scenarii cu intrări/ieșiri multiple, clasa tf.keras.models.Model oferă un API funcțional pentru definirea modelelor. Această abordare permite o mai mare flexibilitate în conectarea straturilor, crearea de grafuri complexe de straturi și definirea de modele cu mai multe intrări sau ieșiri.

from tensorflow.keras.models import Model from tensorflow.keras.layers import Input, Dense, concatenate input_1 = Input(shape=(32,)) input_2 = Input(shape=(64,)) x1 = Dense(16, activation='relu')(input_1) x2 = Dense(32, activation='relu')(input_2) concat = concatenate([x1, x2]) output = Dense(1, activation='sigmoid')(concat) model_functional = Model(inputs=[input_1, input_2], outputs=output)Aici, definim două tensori de intrare și îi procesăm prin straturi Dense separate. Ieșirile acestor straturi sunt apoi concatenate și alimentate într-un strat Dense final pentru a produce ieșirea modelului.

Subclasarea Modelului (Model Subclassing)

Pentru o flexibilitate și mai mare, TensorFlow vă permite să definiți modele personalizate prin subclasarea clasei tf.keras.Model. Această abordare este utilă pentru implementarea arhitecturilor complexe, a straturilor personalizate sau a caracteristicilor avansate, cum ar fi partajarea greutăților sau modelele multi-turn. Permite definirea logicii modelului în metoda call, oferind un control complet asupra fluxului de date.

from tensorflow.keras.models import Model from tensorflow.keras.layers import Dense, Add, Input class ResidualBlock(Model): def __init__(self, units, **kwargs): super().__init__(**kwargs) self.dense1 = Dense(units, activation='relu') self.dense2 = Dense(units) self.add = Add() def call(self, inputs): x = self.dense1(inputs) x = self.dense2(x) return self.add([inputs, x]) inputs = Input(shape=(64,)) x = ResidualBlock(32)(inputs) x = ResidualBlock(32)(x) outputs = Dense(10, activation='softmax')(x) model_subclass = Model(inputs=inputs, outputs=outputs)În acest exemplu, definim un strat personalizat ResidualBlock care implementează o conexiune reziduală. Apoi, instanțiem acest strat de două ori și îl înlănțuim cu alte straturi pentru a construi modelul final.

Iată o scurtă comparație a stilurilor de definire a modelului:

| Stil de Model | Când se utilizează | Avantaje | Dezavantaje |

|---|---|---|---|

Sequential | Arhitecturi simple, liniare | Extrem de ușor de utilizat și de înțeles | Flexibilitate limitată pentru arhitecturi complexe |

Functional API | Modele cu intrări/ieșiri multiple, straturi partajate, grafuri non-liniare | Foarte flexibil, permite grafuri complexe, ușor de inspectat și reutilizat | Poate fi mai complex pentru modele foarte simple |

Model Subclassing | Control complet asupra fluxului de date, straturi personalizate, logici condiționale | Flexibilitate maximă, permite orice arhitectură PyTorch-style | Necesită mai mult cod, poate fi mai greu de depanat sau de salvat (fără configurație serializabilă automată) |

Compilarea Modelului

Înainte de a antrena un model, acesta trebuie compilat cu setări specifice care determină modul în care va fi executat procesul de antrenament. În TensorFlow, puteți compila un model folosind metoda compile() a clasei tf.keras.Model. Această metodă configurează modelul pentru antrenament prin specificarea funcției de pierdere, a optimizatorului și a metricilor care vor fi monitorizate în timpul procesului de antrenament.

Iată un exemplu de compilare a unui model pentru o sarcină de clasificare binară:

from tensorflow.keras.models import Sequential from tensorflow.keras.layers import Dense from tensorflow.keras.optimizers import Adam # Definiți arhitectura modelului (exemplu simplu) model_compilare = Sequential([ Dense(64, activation='relu', input_shape=(10,)), Dense(32, activation='relu'), Dense(1, activation='sigmoid') ]) # Compilați modelul model_compilare.compile(optimizer=Adam(), loss='binary_crossentropy', metrics=['accuracy'])În acest exemplu, definim mai întâi un model secvențial cu trei straturi dense. Apoi, compilăm modelul folosind metoda compile(), specificând următorii parametri:

optimizer: Algoritmul de optimizare utilizat pentru a actualiza greutățile modelului în timpul antrenamentului. În acest caz, folosim optimizatorul Adam, cunoscut pentru eficiența sa.loss: Funcția de pierdere care trebuie minimizată în timpul antrenamentului. Pentru sarcinile de clasificare binară, utilizăm de obicei pierderea de entropie încrucișată binară (binary_crossentropy).metrics: O listă de metrici care vor fi monitorizate în timpul antrenamentului. Aici, urmărim acuratețea predicțiilor modelului.

TensorFlow oferă diverse funcții de pierdere și optimizatori încorporați care pot fi utilizați pentru diferite tipuri de sarcini, cum ar fi regresia, clasificarea multi-clasă și multe altele. Puteți defini, de asemenea, funcții de pierdere și optimizatori personalizați, dacă este necesar.

Antrenarea Efectivă a Modelului

După pregătirea datelor și definirea arhitecturii modelului, următorul pas este antrenarea modelului folosind instanța tf.keras.Model compilată. TensorFlow oferă metoda fit() în acest scop, care încapsulează întregul proces de antrenament.

Pe lângă argumentele menționate anterior (x, y, epochs, batch_size, validation_data), metoda fit() acceptă și alte argumente importante:

callbacks: O listă de funcții de apel invers (callback-uri) care pot fi utilizate pentru a monitoriza și modifica procesul de antrenament. Exemple comune includ:EarlyStopping: Oprește antrenamentul atunci când o metrică monitorizată încetează să se îmbunătățească, prevenind supra-antrenarea.ModelCheckpoint: Salvează greutățile modelului după fiecare epocă, dacă metrica monitorizată s-a îmbunătățit, permițând salvarea celui mai bun model.TensorBoard: Generează log-uri pentru TensorBoard, un instrument de vizualizare puternic pentru monitorizarea progresului antrenamentului.

verbose: Controlează nivelul de detaliu al ieșirii log-ului de antrenament (0 pentru silențios, 1 pentru bară de progres, 2 pentru o linie pe epocă).

În timpul procesului de antrenament, metoda fit() iterează peste datele de antrenament în loturi, calculând pierderea și gradienții pentru fiecare lot. Apoi, actualizează greutățile modelului folosind algoritmul de optimizare specificat. Progresul antrenamentului este afișat în consolă, arătând epoca curentă, valorile pierderii și orice metrici suplimentare specificate în timpul compilării modelului.

from tensorflow.keras.callbacks import EarlyStopping, ModelCheckpoint early_stop = EarlyStopping(monitor='val_loss', patience=5) checkpoint = ModelCheckpoint('best_model.h5', monitor='val_loss', save_best_only=True) # Presupunând că 'model_compilare', 'train_dataset', 'val_dataset' sunt definite # model_compilare.fit(train_dataset, epochs=100, validation_data=val_dataset, callbacks=[early_stop, checkpoint])Evaluarea Performanței Modelului

După antrenarea unui model, este crucial să se evalueze performanța acestuia pe date nevăzute pentru a-i evalua capacitățile de generalizare. TensorFlow oferă mai multe metode și metrici pentru evaluarea performanței modelului, inclusiv metoda evaluate() și diverse funcții de metrică.

Metoda evaluate() calculează valorile pierderii și ale metricilor pentru un set de date dat. Acceptă aceleași argumente ca și metoda fit(), dar în loc să antreneze modelul, îl evaluează pe datele furnizate.

# Presupunând că 'test_dataset' este definit # loss, accuracy = model_compilare.evaluate(test_dataset) # print(f'Test loss: {loss:.4f}') # print(f'Test accuracy: {accuracy:.4f}')În plus față de metoda evaluate(), TensorFlow oferă diverse funcții de metrică care pot fi utilizate pentru a calcula metrici de performanță specifice. Aceste metrici pot fi utile în special atunci când se lucrează cu sarcini complexe sau când trebuie să evaluați aspecte specializate ale performanței modelului. De exemplu, pentru o clasificare binară, puteți urmări Precision și Recall.

from tensorflow.keras.metrics import Precision, Recall # Recompilăm modelul pentru a include noile metrici # model_compilare.compile(optimizer='adam', loss='binary_crossentropy', metrics=[Precision(), Recall()]) # precision, recall = model_compilare.evaluate(test_dataset)[1:] # [1:] pentru a exclude loss # print(f'Precision: {precision:.4f}') # print(f'Recall: {recall: .4f}')TensorFlow oferă, de asemenea, utilitare pentru vizualizarea și analiza performanței modelului, cum ar fi matricile de confuzie și rapoartele de clasificare. Aceste instrumente pot fi deosebit de utile pentru înțelegerea punctelor forte și a punctelor slabe ale modelului și identificarea zonelor de îmbunătățire.

Personalizarea Procesului de Antrenament: Dincolo de fit() Standard

Deși metoda fit() din Keras este extrem de puternică și acoperă majoritatea scenariilor de antrenament, există situații în care aveți nevoie de un control mai fin asupra buclei de antrenament. Aici intervine personalizarea pasului de antrenament prin suprascrierea metodei train_step().

De ce să personalizezi train_step()?

Keras's fit() gestionează totul în culise: trecerea înainte (forward pass), trecerea înapoi (backward pass), calculul pierderii și actualizarea greutăților. Cu toate acestea, dacă doriți să modificați oricare dintre aceste aspecte, aveți nevoie să interveniți și să redefiniți bucla de antrenament. Motivele pot include:

- Implementarea unor funcții de pierdere personalizate foarte complexe care necesită o logică specifică.

- Experimentarea cu tehnici noi de optimizare.

- Adăugarea de logare personalizată sau de calcule intermediare specifice.

- Controlul comportamentului în cazul antrenamentului distribuit.

Cum să suprascrii metoda train_step()

Pentru a personaliza comportamentul de antrenament, trebuie să subclasați clasa Keras Model și să-i suprascrieți metoda train_step(). Iată un ghid simplu pentru a începe:

import tensorflow as tf class CustomModel(tf.keras.Model): def train_step(self, data): # 1. Despachetați datele x, y = data with tf.GradientTape() as tape: # 2. Trecerea înainte (Forward pass) y_pred = self(x, training=True) # 3. Calculați pierderea loss = self.compiled_loss(y, y_pred, regularization_losses=self.losses) # 4. Calculați gradienții gradients = tape.gradient(loss, self.trainable_variables) # 5. Actualizați greutățile self.optimizer.apply_gradients(zip(gradients, self.trainable_variables)) # 6. Actualizați metricile self.compiled_metrics.update_state(y, y_pred) # 7. Returnează un dicționar cu metricile de performanță return {m.name: m.result() for m in self.metrics}Să descompunem acest train_step() personalizat:

- Despachetarea datelor:

xșiysunt caracteristicile de intrare și etichetele țintă, respectiv. - Gradient Tape: Acest manager de context (

tf.GradientTape) urmărește operațiile pentru a calcula gradienții pentru retropropagare (backpropagation). - Trecerea înainte: Modelul face predicții (

y_pred) folosind greutățile curente. Argumentultraining=Trueeste important pentru straturile care se comportă diferit în timpul antrenamentului și inferenței (e.g., Dropout, BatchNorm). - Calculul pierderii: Pierderea este calculată pe baza diferenței dintre predicții (

y_pred) și valorile reale (y). Se utilizează pierderea compilată a modelului (cea specificată înmodel.compile()). - Calculul gradienților: Gradienții sunt calculați în raport cu pierderea, folosind

tape.gradient. - Actualizarea greutăților: Optimizatorul ajustează greutățile modelului folosind gradienții calculați.

- Actualizarea metricilor: Metricele de performanță (acuratețe, pierdere etc.) sunt actualizate după fiecare pas de antrenament.

- Returnarea metricilor: Metoda returnează un dicționar cu numele și rezultatele metricilor.

Adăugarea de Funcționalități Personalizate la train_step()

Odată ce ați suprascris cu succes train_step(), puteți explora cum să adăugați mai multe caracteristici personalizate, cum ar fi logarea avansată sau experimentarea cu noi tehnici de optimizare.

- Funcții de pierdere personalizate: Puteți defini funcții de pierdere complexe și să le integrați în metoda

train_step(). - Tăierea gradientului (Gradient Clipping): Pentru a evita gradienții explozivi, puteți tăia valorile acestora în timpul pasului de retropropagare:

gradients = tape.gradient(loss, self.trainable_variables) clipped_gradients = [tf.clip_by_value(grad, -1.0, 1.0) for grad in gradients] self.optimizer.apply_gradients(zip(clipped_gradients, self.trainable_variables)) - Logare personalizată: Puteți înregistra metrici sau ieșiri personalizate în timpul antrenamentului, ajutând la depanare și urmărirea performanței buclei de antrenament personalizate.

După definirea modelului personalizat cu train_step() suprascris, puteți utiliza funcția fit() ca înainte pentru a antrena modelul. Metoda train_step() va fi invocată automat în timpul fiecărui lot, oferindu-vă control complet asupra procesului de antrenament.

Keras Sequential: Simplitate și Eficiență

Pe lângă tf.keras.Model, Keras oferă clasa tf.keras.Sequential, care este un caz special de model în care modelul este pur și simplu o stivă de straturi cu o singură intrare și o singură ieșire. Este cea mai simplă modalitate de a construi un model Keras și este ideală pentru majoritatea arhitecturilor de rețele neuronale de bază.

Un model Sequential poate fi creat prin transmiterea unei liste de instanțe de straturi constructorului:

import keras model_sequential_simple = keras.Sequential([ keras.Input(shape=(None, None, 3)), keras.layers.Conv2D(filters=32, kernel_size=3), keras.layers.MaxPooling2D(pool_size=(2, 2)), keras.layers.Flatten(), keras.layers.Dense(10, activation='softmax') ])Avantajul principal al modelelor Sequential este simplitatea și ușurința de utilizare. Ele sunt excelente pentru prototipare rapidă și pentru scenarii în care fluxul de date este strict liniar, fără ramificații, intrări multiple sau ieșiri multiple. Cu toate acestea, pentru arhitecturi mai complexe, veți avea nevoie de API-ul funcțional sau de subclasarea modelului.

Metrice în Keras: Măsurarea Succesului

Metricele sunt instrumente esențiale în învățarea automată, oferind o modalitate de a cuantifica performanța unui model. În Keras, metricile sunt utilizate pentru a monitoriza progresul antrenamentului și pentru a evalua calitatea predicțiilor modelului, atât în timpul antrenamentului, cât și la testare. Ele sunt specificate în metoda compile() a modelului.

Spre deosebire de funcția de pierdere, care este optimizată direct de algoritmul de antrenament, metricile sunt pur și simplu raportate pentru a oferi o perspectivă asupra performanței. Ele nu influențează direct actualizarea greutăților modelului, deși pot fi folosite de callback-uri (cum ar fi EarlyStopping) pentru a controla procesul de antrenament.

Cum se utilizează metricile în Keras

Metricile sunt adăugate la model în timpul fazei de compilare, prin argumentul metrics:

model.compile(optimizer='adam', loss='categorical_crossentropy', metrics=['accuracy', 'precision', 'recall'])Puteți utiliza șiruri de caractere pentru metricile încorporate (cum ar fi 'accuracy', 'mse', 'mae') sau puteți instanția obiecte de metrică din modulul tf.keras.metrics pentru un control mai fin sau pentru metrici personalizate.

Tipuri comune de Metrice

Keras oferă o gamă largă de metrici încorporate pentru diverse sarcini:

- Metrice de clasificare:

'accuracy': Fracția de predicții corecte.BinaryAccuracy(): Acuratețe pentru sarcini de clasificare binară.CategoricalAccuracy(): Acuratețe pentru sarcini de clasificare multi-clasă one-hot encoded.SparseCategoricalAccuracy(): Acuratețe pentru sarcini de clasificare multi-clasă cu etichete întregi.Precision(): Proporția de predicții pozitive corecte din totalul predicțiilor pozitive.Recall(): Proporția de predicții pozitive corecte din totalul cazurilor pozitive reale.AUC(): Aria sub curba ROC (Receiver Operating Characteristic), utilă pentru clasificarea binară.F1Score(): Media armonică a preciziei și a reamintirii.

- Metrice de regresie:

'mse'(Mean Squared Error): Media pătratelor diferențelor dintre predicții și valorile reale.'mae'(Mean Absolute Error): Media valorilor absolute ale diferențelor.RootMeanSquaredError(): Rădăcina pătrată a MSE.

Metrice ponderate (weighted_metrics)

Pe lângă argumentul metrics, există și weighted_metrics. Acest lucru este util atunci când doriți ca anumite eșantioane sau clase să aibă o influență mai mare asupra valorii metricii, de exemplu, în seturi de date dezechilibrate unde doriți să acordați mai multă importanță claselor subreprezentate. Metricele specificate aici vor fi ponderate de sample_weight sau class_weight în timpul antrenamentului și evaluării.

Monitorizarea atentă a metricilor este crucială pentru înțelegerea modului în care modelul învață și pentru a lua decizii informate privind ajustările hiperparametrilor sau modificările arhitecturii.

Întrebări Frecvente (FAQ)

- Ce este supra-antrenarea (overfitting) și cum o previne

model.fit()? - Supra-antrenarea apare atunci când un model învață prea bine datele de antrenament, inclusiv zgomotul, și pierde capacitatea de a generaliza pe date noi, nevăzute. Metoda

model.fit()ajută la prevenirea supra-antrenării prin utilizareavalidation_datași a callback-urilor precumEarlyStopping.validation_datapermite monitorizarea performanței modelului pe un set separat de date, iarEarlyStoppingpoate opri antrenamentul dacă performanța pe setul de validare începe să scadă, indicând supra-antrenarea. - Pot antrena un model pe mai multe GPU-uri cu

model.fit()? - Da, TensorFlow și Keras oferă API-uri pentru antrenament distribuit, cum ar fi

tf.distribute.Strategy. Puteți încapsula modelul și optimizatorul într-o strategie de distribuție, iarmodel.fit()va gestiona automat distribuția antrenamentului pe mai multe dispozitive (GPU-uri sau TPU-uri) sau mașini. - Care este diferența dintre

model.fit(),model.train_on_batch()șimodel.train_step()? model.fit(): Este funcția de nivel înalt care gestionează întreaga buclă de antrenament, inclusiv iterarea prin epoci și loturi, aplicarea callback-urilor și calcularea metricilor. Este cea mai simplă metodă de utilizat pentru majoritatea cazurilor.model.train_on_batch(): Execută un singur pas de antrenament (o singură actualizare a gradientului) pe un singur lot de date. Este utilă pentru bucle de antrenament personalizate, unde doriți să gestionați manual loturile de date.model.train_step(): Aceasta este metoda internă a claseitf.keras.Modelcare definește logica unui singur pas de antrenament pentru un lot. Suprascrierea acestei metode vă oferă cel mai granular control asupra modului în care modelul învață, permițând personalizări avansate, dar necesită mai multă muncă manuală.

- Cât de mult ar trebui să dureze antrenamentul unui model?

- Durata antrenamentului depinde de mai mulți factori: dimensiunea și complexitatea setului de date, arhitectura modelului (numărul de parametri), puterea de calcul disponibilă (CPU, GPU, TPU), și hiperparametri precum

epochsșibatch_size. Nu există un răspuns unic; scopul este să antrenați modelul suficient pentru a atinge o performanță bună pe datele de validare, fără a supra-antrena.

Concluzie

Funcția tf.keras.Model.fit este un instrument incredibil de puternic și flexibil pentru antrenarea modelelor de învățare automată în TensorFlow și Keras. De la pregătirea eficientă a datelor cu tf.data.Dataset, la definirea arhitecturilor complexe și la personalizarea buclei de antrenament prin suprascrierea train_step(), Keras oferă un set robust de instrumente pentru a construi și optimiza modele de top. Înțelegerea profundă a acestor concepte vă va permite să deblocați întregul potențial al modelelor dumneavoastră și să abordați cu succes o gamă largă de provocări în inteligența artificială.

Prin utilizarea eficientă a parametrilor fit(), a callback-urilor și a metricilor, puteți nu doar să antrenați modele, ci să o faceți într-un mod inteligent, monitorizat și adaptabil, asigurând performanța și generalizarea optimă a soluțiilor dumneavoastră.

Dacă vrei să descoperi și alte articole similare cu Antrenează-ți Modelele Keras Eficient!, poți vizita categoria Fitness.