28/04/2026

În lumea complexă și dinamică a învățării automate (Machine Learning), succesul unui model depinde fundamental de calitatea și modul în care sunt gestionate datele. Un aspect crucial, adesea subiect de confuzie pentru începători, este distincția dintre seturile de date de antrenament, validare și testare. Deși toate provin din același set inițial de date și sunt indispensabile pe parcursul ciclului de viață al unui model ML, ele joacă roluri distincte și complementare. Înțelegerea profundă a acestor diferențe nu este doar un detaliu tehnic, ci o piatră de temelie pentru construirea unor modele predictive fiabile, generalizabile și performante în scenarii din lumea reală. Acest articol va demistifica aceste concepte, explicând rolul specific al fiecărui set de date, metodele de creare și importanța lor colectivă în asigurarea integrității și coerenței procesului de dezvoltare a modelelor.

- Înțelegerea Setului de Date de Antrenament

- Rolul Vital al Datelor de Validare

- Importanța Setului de Date de Testare

- Diferențe Cheie: Antrenament vs. Validare vs. Testare

- Metode de Împărțire a Datelor

- Greșeli Comune în Împărțirea Datelor

- Calitatea Datelor: Cantitate, Calitate și Diversitate

- Întrebări Frecvente

- Concluzie

Înțelegerea Setului de Date de Antrenament

Setul de date de antrenament reprezintă fundamentul pe care un model de învățare automată își construiește cunoștințele. Este secțiunea cea mai mare și cea mai activ utilizată a setului de date, concepută pentru a expune modelul la o gamă largă de exemple și scenarii. Prin intermediul acestor date, algoritmul învață să identifice tipare, să înțeleagă relațiile dintre variabilele de intrare (caracteristici) și variabilele de ieșire (etichete sau rezultate țintă), și să își ajusteze parametrii interni pentru a minimiza erorile de predicție. Acesta este locul unde modelul „învață” efectiv, adaptându-se iterativ prin procese precum retropropagarea și descendentul de gradient, pentru a-și îmbunătăți continuu acuratețea predictivă.

Definiția și Rolul Datelor de Antrenament în ML

Datele de antrenament sunt sursa primară de informații pentru procesul de învățare al unui model ML. Ele sunt compuse dintr-o serie de exemple, fiecare conținând caracteristici de intrare și etichetele sau rezultatele țintă corespunzătoare. În cazul învățării supervizate, aceste etichete predefinite permit algoritmului să deducă conexiuni și tipare ascunse în date. Scopul principal este dublu: pe de o parte, oferă modelului exemple din care să învețe, iar pe de altă parte, îi permite să-și calibreze parametrii interni pentru a reduce la minimum erorile de predicție. Fără un set de antrenament robust și reprezentativ, modelul nu ar avea baza necesară pentru a înțelege complexitatea datelor și pentru a face predicții informate.

Caracteristicile Seturilor de Date de Antrenament

Seturile de antrenament sunt, de obicei, destul de mari. Ele pot conține de la mii la milioane de observații, asigurând o reprezentare diversă a distribuției subiacente a datelor. Această amploare este crucială pentru ca modelul să poată învăța dintr-o gamă largă de exemple și să-și aplice cunoștințele în mod eficient pe date necunoscute. Pe lângă volum, datele de antrenament trebuie să fie etichetate corespunzător, fiecare valoare țintă sau rezultat fiind cunoscut și asociat cu caracteristicile de intrare respective. Această adnotare a datelor este inestimabilă pentru a învăța modelul cum să lege caracteristicile de intrare cu rezultatele țintă.

Mai mult, este esențial ca seturile de antrenament să reflecte scenariile din lumea reală pe care modelul este menit să le întâlnească în viitor. Această reprezentativitate asigură că modelul este aplicabil și generalizabil în diferite contexte. Acest lucru se realizează prin selectarea și organizarea datelor de antrenament pentru a capta gama de variabilitate și complexitate prezentă în domeniul țintă. Adesea, aceste seturi de date pot include zgomot, valori aberante sau valori lipsă, ceea ce necesită tehnici de preprocesare și curățare pentru a îmbunătăți calitatea și fiabilitatea datelor. Depășirea acestor obstacole ajută la asigurarea faptului că datele de antrenament susțin în mod adecvat procesele de învățare și contribuie la construirea unor modele de învățare automată precise.

Pregătirea și Preprocesarea Datelor de Antrenament

Pregătirea și preprocesarea datelor de antrenament sunt pași cruciali în procesul ML care influențează direct calitatea și performanța modelelor. Datele brute trebuie să treacă prin mai multe etape înainte de a fi introduse în algoritmii ML: curățarea datelor pentru a elimina valorile aberante și erorile, ingineria caracteristicilor pentru a extrage informații relevante și scalarea caracteristicilor pentru a normaliza distribuția datelor.

În plus, preprocesarea poate implica gestionarea valorilor lipsă, codificarea variabilelor categorice și efectuarea reducerii dimensionalității pentru a crește eficiența și a preveni supraantrenarea (overfitting). Metodele de augmentare a datelor pot fi, de asemenea, utilizate pentru a extinde seturile de date de antrenament, mai ales atunci când datele etichetate sunt limitate sau dezechilibrate. Prin adăugarea de exemple generate sintetic sau transformări la datele de antrenament, practicienii pot îmbunătăți robustețea modelului și acuratețea predicției.

Rolul Vital al Datelor de Validare

Setul de date de validare joacă un rol distinct și esențial în ciclul de dezvoltare al unui model de învățare automată. Spre deosebire de setul de antrenament, care este folosit pentru a învăța modelul, setul de validare este utilizat pentru a rafina modelul și pentru a-i evalua eficacitatea în timpul procesului de antrenament. Acesta acționează ca o oglindă, oferind feedback rapid despre performanța modelului pe date nevăzute, permițând ajustări continue fără a compromite obiectivitatea evaluării finale.

Definiția și Rolul în ML

Datele de validare ajută la rafinarea modelelor și la evaluarea eficacității acestora. În timp ce datele de antrenament sunt folosite pentru a antrena parametrii modelului, datele de validare sunt utilizate pentru a evalua capacitatea de generalizare a modelului și pentru a identifica potențiale probleme – de exemplu, supraantrenarea (overfitting) sau subantrenarea (underfitting). Prin alocarea unei porțiuni din date pentru validare în timpul antrenării modelului, profesioniștii pot lua decizii informate privind selectarea modelelor, ajustarea hiperparametrilor și optimizarea performanței generale. Acest set permite dezvoltatorilor să „simtă pulsul” modelului, asigurându-se că acesta învață tipare generale și nu doar memorează zgomotul din datele de antrenament.

Caracteristicile Seturilor de Date de Validare

Seturile de validare împărtășesc unele similitudini cu seturile de antrenament, dar au totuși caracteristicile lor distincte. Similar cu datele de antrenament, datele de validare includ caracteristici de intrare și etichete țintă corespunzătoare, permițând sarcini de învățare supervizată. Cu toate acestea, seturile de validare sunt, de obicei, mai mici ca dimensiune decât seturile de antrenament, deoarece sunt utilizate pentru evaluare, nu pentru antrenarea modelului. Este crucial ca seturile de date de validare să fie reprezentative pentru distribuția mai largă a datelor, pentru a asigura că performanța modelului reflectă capacitatea sa de a generaliza în situații din lumea reală.

Cum sunt create Datele de Validare?

Crearea datelor de validare implică împărțirea setului de date inițial în subseturi de antrenament și validare. O metodă comună este abordarea holdout, unde o porțiune din date este pusă deoparte pentru validare, în timp ce restul este folosit pentru antrenament. O altă tehnică este validarea încrucișată k-fold, unde setul de date este împărțit în k folduri de dimensiuni egale, fiecare servind pe rând ca set de validare. Aceste metode îi ajută pe practicieni să evalueze eficient performanța modelului, utilizând în același timp datele în mod optim. Studii recente au arătat importanța seturilor de date de validare externă în modelarea predictivă, demonstrând că acestea pot îmbunătăți semnificativ acuratețea predicției prin validarea modelului pe date complet noi și independente.

Importanța Setului de Date de Testare

Setul de date de testare reprezintă evaluarea finală, obiectivă și imparțială a performanței unui model de învățare automată. Este ultima etapă în ciclul de dezvoltare a modelului, unde se verifică modul în care modelul antrenat și validat se comportă pe date complet necunoscute, simulând scenarii din lumea reală. Acest set este esențial pentru a confirma capacitatea de generalizare a modelului și pentru a oferi o estimare realistă a puterii sale predictive înainte de implementare.

Definiția și Rolul în ML

Datele de testare joacă un rol crucial în faza finală de evaluare a procesului ML: ele oferă o evaluare imparțială a performanței unui model antrenat pe date nevăzute. Spre deosebire de seturile de date de antrenament și validare, setul de testare este păstrat separat până la etapa de evaluare pentru a menține obiectivitatea și a garanta credibilitatea măsurătorilor de performanță. Scopul principal al datelor de testare este de a determina cât de bine se poate adapta modelul la noi instanțe și de a evalua precizia sa predictivă în medii reale. Aceasta este „proba de foc” a modelului, unde se demonstrează dacă predicțiile sale sunt cu adevărat fiabile și utile.

Caracteristicile Seturilor de Date de Testare

Seturile de testare includ date nevăzute pentru a evalua cât de bine va funcționa modelul final în viața reală după ce este pus în acțiune. Aceste seturi de date reflectă populația generală și păstrează distribuția datelor pentru a asigura că metricile de performanță sunt fiabile și indicative pentru modul în care modelul va funcționa în utilizare reală. Este crucial ca setul de testare să fie complet independent de seturile de antrenament și validare, evitând orice formă de scurgere de date (data leakage) care ar putea duce la o evaluare supra-optimistă a performanței modelului.

Cum se generează Datele de Testare?

Seturile de date de testare sunt, de asemenea, create folosind metode de împărțire a datelor. Seturile de testare rămân separate de seturile de antrenament și validare pe parcursul dezvoltării modelului, pentru a evalua ulterior cu precizie performanța modelului pe date necunoscute. O practică comună este utilizarea unor seturi de date externe sau a datelor din lumea reală colectate din medii de producție ca date de testare pentru a evalua performanța modelului în aplicații practice. Această abordare ajută la confirmarea faptului că modelul se poate adapta și gestiona situațiile din lumea reală dincolo de ceea ce a fost văzut în fazele de antrenament și validare.

Diferențe Cheie: Antrenament vs. Validare vs. Testare

Pentru a clarifica și mai mult rolurile distincte ale acestor trei seturi de date, iată o comparație detaliată:

| Aspect | Date de Antrenament | Date de Validare | Date de Testare |

|---|---|---|---|

| Scop | Utilizate pentru a antrena modelul, permițându-i să învețe și să se adapteze la date. | Utilizate pentru a ajusta hiperparametrii și a evita supraantrenarea, oferind o evaluare imparțială a modelului în timpul antrenamentului. | Utilizate pentru a evalua performanța finală a modelului după antrenament și validare, oferind o evaluare imparțială a puterii sale predictive în scenarii din lumea reală. |

| Momentul Utilizării | Pe parcursul fazei inițiale a procesului de învățare automată. | După ce modelul a fost antrenat inițial pe datele de antrenament. | După ce modelul a fost antrenat și validat, la finalul procesului de învățare automată. |

| Caracteristici | Trebuie să reprezinte întregul spectru de date și scenarii pe care modelul le va întâlni. De obicei, cel mai mare set. | Ar trebui să fie reprezentative pentru setul de date pentru a valida capacitatea modelului de a generaliza. Mai mici decât setul de antrenament. | Reprezentative pentru datele din lumea reală pe care modelul le va întâlni post-implementare pentru a evalua cu precizie performanța sa. Complet nevăzute de model anterior. |

Metode de Împărțire a Datelor

Împărțirea datelor este o practică fundamentală în învățarea automată. Aceasta implică divizarea unui set de date în părți pentru antrenament, validare și testare. Această partiționare permite practicienilor să dezvolte și să evalueze eficient modelele de învățare automată, asigurând performanțe fiabile și generalizarea la date nevăzute. Prin împărțirea setului de date, experții pot evalua performanța modelului, pot ajusta setările și pot confirma rezultatele înainte de a utiliza modelul în sarcini din viața reală.

Eșantionarea Aleatorie

Eșantionarea aleatorie este un proces de alegere nesistematică a punctelor de date dintr-un set de date pentru a crea seturi de antrenament, validare și testare. Această metodă este utilizată în mod obișnuit cu seturi de date diverse. Eșantionarea aleatorie asigură că fiecare subset reprezintă distribuția generală a datelor, reducând părtinirea și susținând antrenarea și evaluarea modelului.

Împărțirea Stratificată

Această metodă menține distribuția claselor în fiecare subset: setul de date este împărțit, dar proporțiile relative ale fiecărei clase sunt păstrate. Acest lucru are ca rezultat seturi de antrenament, validare și testare care conțin un subset reprezentativ din fiecare clasă – acest lucru menține distribuția originală a claselor. Abordarea împărțirii stratificate este valoroasă pentru seturile de date dezechilibrate, unde unele clase pot fi mai puțin comune. Aceasta este o metodă excelentă pentru prevenirea părtinirii în seturile de date.

Validarea Încrucișată (Cross-validation)

Aceasta implică împărțirea setului de date în seturi de antrenament și validare pentru antrenarea și evaluarea modelului. Această tehnică ajută la stabilizarea performanței modelului prin medierea rezultatelor pe parcursul mai multor rulări. Metodele populare de validare încrucișată includ K-fold și validarea încrucișată stratificată k-fold.

Metoda Holdout

Cu această abordare, setul de date este împărțit în două părți: una pentru antrenarea modelului și alta pentru testarea performanței sale. De obicei, o porțiune mai mare este alocată pentru scopuri de antrenament, în timp ce o porțiune mai mică este păstrată pentru a evalua modelul. Metoda de împărțire a datelor holdout ajută la prevenirea supraantrenării și asigură că modelul este testat pe date nevăzute.

Împărțirea Bazată pe Timp

Această abordare se bazează pe împărțirea datelor temporale în seturi de antrenament, validare și testare pe baza ordinii cronologice. Împărțirea bazată pe timp este utilizată în sarcini de modelare predictivă (de exemplu, prognoza seriilor temporale și analiza financiară), unde datele istorice sunt utilizate pentru antrenament, datele recente – pentru validare, iar datele viitoare – pentru testare. Această metodă asigură că modelele sunt evaluate utilizând informații practice pentru a face predicții precise.

Studiile au demonstrat că alegerea tehnicii de împărțire a datelor poate influența în mare măsură cât de bine funcționează și generalizează un model. O cercetare recentă subliniază importanța selectării metodei corecte de împărțire a datelor pentru a estima performanța de generalizare a modelelor. Aceasta arată că, deși toate metodele de împărțire a datelor pot aduce rezultate comparabile pentru seturile de date mari, metode diferite utilizate pentru seturile de date mici pot afecta în mod diferit performanța modelului. Cercetarea constată că nicio metodă nu depășește în mod constant pe altele în toate scenariile – alegerea optimă a tehnicii de împărțire a datelor și a parametrilor depinde de datele în sine. Acest lucru subliniază importanța distribuției echilibrate a datelor între seturile de antrenament, validare și testare, în special pentru a evita supraantrenarea în seturile de date mici și pentru a obține o generalizare robustă a modelului.

Greșeli Comune în Împărțirea Datelor

Deoarece împărțirea datelor este un pas fundamental în dezvoltarea modelelor ML, există greșeli comune de care practicienii ar trebui să fie conștienți pentru a asigura fiabilitatea și acuratețea modelelor lor. Iată câteva dintre cele mai răspândite erori în împărțirea datelor:

- Scurgerea de date (Data Leakage): Scurgerea de date se întâmplă atunci când informații din setul de validare sau de testare se amestecă accidental în setul de antrenament, rezultând estimări de performanță excesiv de optimiste. Acest lucru poate apărea dacă pași de preprocesare, cum ar fi scalarea caracteristicilor sau imputarea, sunt aplicați setului de date înainte de împărțire, în loc să fie aplicați separat fiecărui subset.

- Împărțirea dezechilibrată: Aceasta se referă la împărțirea inegală a datelor între subseturi, cauzând o evaluare părtinitoare a modelului. Acest lucru se poate întâmpla atunci când setul de date conține proporții inegale de clase sau categorii, iar metoda de împărțire nu ia în considerare acest dezechilibru. Metodele de împărțire stratificată pot ajuta la abordarea acestei probleme prin menținerea distribuțiilor claselor între subseturi.

- Metrici de evaluare incorecte: Utilizarea unor metrici de evaluare inadecvate poate duce la concluzii înșelătoare despre performanța modelului. De exemplu, acuratețea poate să nu fie potrivită pentru seturile de date dezechilibrate, deoarece poate fi puternic influențată de clasa majoritară. Oamenii de știință în date ar trebui să aleagă cu atenție metricile de evaluare pe baza caracteristicilor datelor lor și a obiectivelor sarcinii lor de învățare automată.

- Supraantrenarea la datele de validare: Supraantrenarea are loc atunci când parametrii sau hiperparametrii modelului sunt optimizați în mod repetat pe baza feedback-ului setului de validare. Acest lucru poate determina modelul să învețe tiparele specifice, zgomotul sau anomaliile din datele de validare, mai degrabă decât caracteristicile generalizabile subiacente ale setului de date. Chiar dacă modelul ar putea funcționa excelent pe setul de validare, eficiența sa poate scădea atunci când se confruntă cu date noi (setul de testare), indicând că nu a înțeles cu adevărat relațiile predictive.

Calitatea Datelor: Cantitate, Calitate și Diversitate

Un algoritm este, într-un fel, la fel de bun ca datele sale de antrenament – așa cum spune zicala, „gunoi la intrare, gunoi la ieșire”. Datele de antrenament eficiente sunt construite pe trei componente cheie, valabile pentru toate cele trei seturi de date:

- Cantitate: Un algoritm robust are nevoie de o mulțime de date de antrenament pentru a învăța să interacționeze cu utilizatorii și să se comporte în cadrul aplicației. Gândiți-vă la oameni; trebuie să asimilăm o mulțime de informații înainte de a ne putea numi experți în orice. Nu este diferit pentru software. Planificați să utilizați o mulțime de date de antrenament, validare și testare. Aceste tipuri de date asigură că algoritmul ține cont de toate utilizările și scenariile așteptate. Și așteptați-vă să adăugați mult mai multe date în timp.

- Calitate: Volumul singur va duce algoritmul doar până la un anumit punct. Calitatea datelor este la fel de importantă. Aceasta înseamnă colectarea de date din lumea reală. Datele multimodale, cum ar fi vocile, imaginile, videoclipurile, documentele, sunetele și alte forme de intrare, antrenează, de asemenea, modelul. Datele din lumea reală sunt critice, deoarece imită modul în care o aplicație va primi intrări de la utilizator. Astfel, datele din lumea reală oferă aplicației tale cea mai bună șansă de succes. De exemplu, algoritmii ML care se bazează pe intrări vizuale și/sau sonore ar trebui să obțină date de antrenament de la același hardware sau condiții de mediu similare așteptate odată implementate.

- Diversitate: A treia piesă a puzzle-ului este diversitatea datelor, care este esențială pentru a elimina problema temută a părtinirii AI. Părtinirea apare atunci când algoritmii sunt alimentați cu date de antrenament, validare sau testare care duc la rezultate trase de-a lungul unor linii discriminatorii. În aceste cazuri, algoritmul ML oferă rezultate care pot fi considerate părtinitoare față de sau împotriva unui anumit sex, rasă, grup de vârstă, limbă sau cultură, în funcție de modul în care se manifestă. Asigurați-vă că algoritmul a „văzut totul” înainte de a lansa aplicația și de a vă baza pe ea pentru a funcționa singură.

Întrebări Frecvente

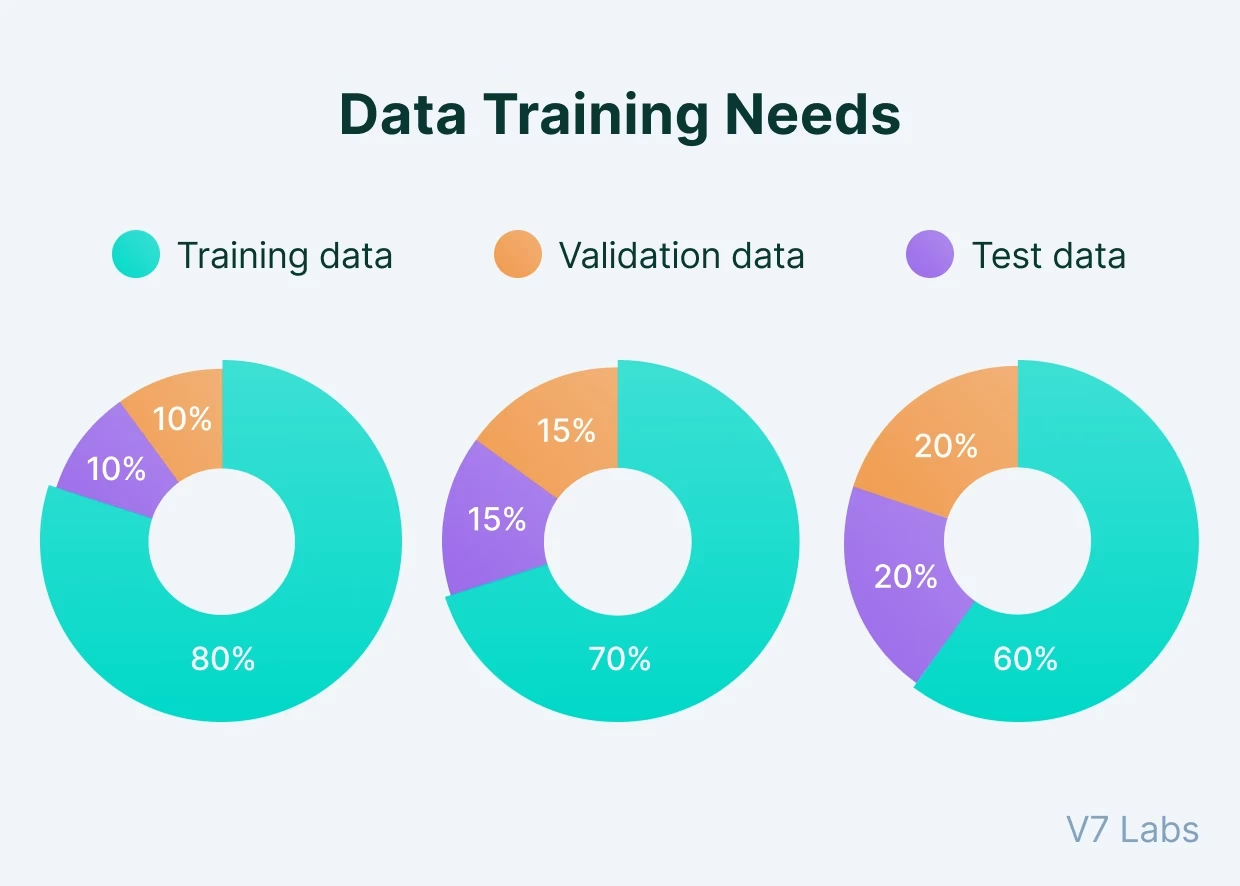

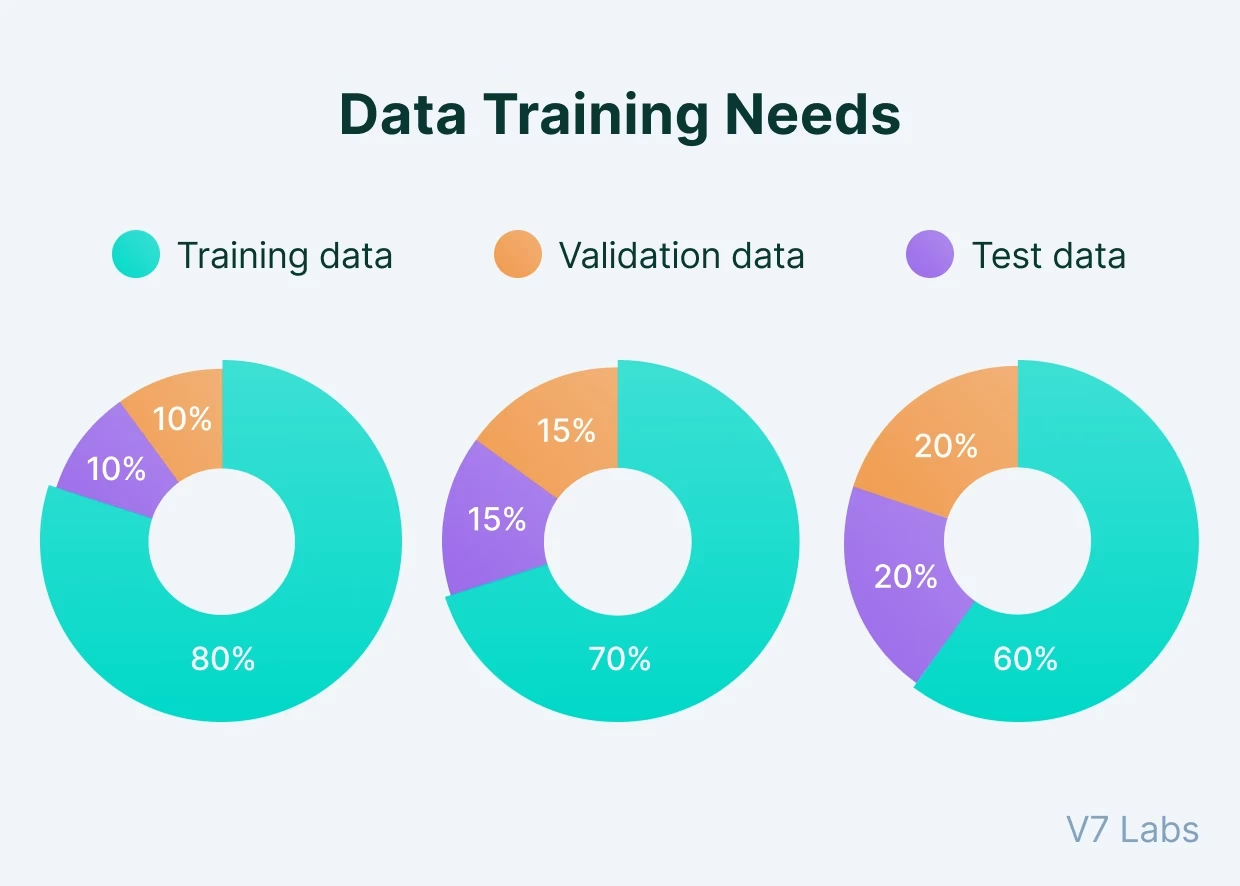

Care este proporția ideală pentru împărțirea datelor?

Nu există o proporție „perfectă” universal valabilă, deoarece depinde de dimensiunea și natura setului tău de date. Sugestiile populare includ 80/10/10 (antrenament/validare/testare), 70/15/15 sau 60/20/20. Pentru seturi de date foarte mari, o proporție mai mică pentru validare și testare (de exemplu, 90/5/5) poate fi suficientă, deoarece chiar și o mică fracțiune va conține un număr suficient de exemple.

De ce nu se folosește setul de testare în timpul antrenamentului?

Setul de testare este păstrat complet separat și nevăzut de model până la final pentru a oferi o evaluare obiectivă și imparțială a performanței modelului pe date complet noi. Dacă ar fi folosit în timpul antrenamentului sau validării, modelul ar putea „memora” datele din setul de testare, ducând la o estimare supra-optimistă a capacității sale de generalizare, fenomen cunoscut sub numele de supraantrenare (overfitting).

Ce este supraantrenarea (overfitting) și cum ajută setul de validare?

Supraantrenarea apare atunci când un model învață prea bine detaliile și zgomotul din datele de antrenament, în loc să învețe tiparele generale. Drept urmare, performanța sa pe date noi și nevăzute scade semnificativ. Setul de validare ajută la detectarea supraantrenării în timpul antrenamentului. Dacă performanța modelului pe setul de antrenament continuă să se îmbunătățească, dar performanța pe setul de validare începe să scadă, este un semn că modelul începe să se supraantreneze, iar antrenamentul ar trebui oprit sau ajustat.

Ce este scurgerea de date (data leakage)?

Scurgerea de date este o eroare gravă în care informații din setul de validare sau testare se „scurg” accidental în setul de antrenament. Acest lucru poate duce la estimări de performanță artificial de bune, deoarece modelul a văzut deja (indirect) datele pe care ar trebui să le prezică. Un exemplu comun este aplicarea scalării caracteristicilor pe întregul set de date înainte de a-l împărți, în loc să se scaleze fiecare subset independent.

Concluzie

În rezumat, seturile de date de antrenament, validare și testare joacă roluri cruciale în crearea, evaluarea și implementarea modelelor de învățare automată. Este important să înțelegem distincțiile dintre aceste subseturi și să alegem cele mai potrivite metode de partiționare a datelor pentru a asigura acuratețea și fiabilitatea sistemelor ML. Setul de antrenament este fundația pe care modelul învață, setul de validare este instrumentul de rafinare și de prevenire a supraantrenării, iar setul de testare este judecătorul imparțial al performanței finale. Împreună, aceste seturi asigură că un model nu doar că învață, ci și generalizează eficient și oferă predicții de încredere în medii din lumea reală. Pe măsură ce învățarea automată continuă să avanseze, progresele în tehnicile de împărțire a datelor vor fi esențiale pentru a susține progresul și a îmbunătăți dezvoltarea unor sisteme ML puternice și responsabile.

Dacă vrei să descoperi și alte articole similare cu Date de Antrenament, Validare și Testare: Diferențe Cheie, poți vizita categoria Fitness.