24/08/2024

În era digitală actuală, inteligența artificială (AI) a devenit o prezență omniprezentă, de la asistenții vocali din telefoane până la sistemele complexe care analizează date medicale. Cu toate acestea, în spatele fiecărei aplicații AI se ascund două procese fundamentale, adesea confundate, dar distincte: antrenamentul AI și inferența AI. Înțelegerea diferenței dintre aceste două etape este crucială pentru oricine dorește să navigheze eficient în peisajul AI, fie că este vorba de dezvoltatori, manageri de proiect sau simpli curioși.

Așa cum un detectiv celebru, precum Sherlock Holmes, își rafinează abilitățile de observare și deducție pe baza experiențelor anterioare, iar apoi le aplică în cazuri noi, la fel și sistemele AI trec printr-o fază de învățare intensă (antrenament) și o fază de aplicare a cunoștințelor (inferență). Să explorăm în detaliu fiecare dintre aceste concepte și de ce distincția este atât de importantă.

Ce este Antrenamentul AI?

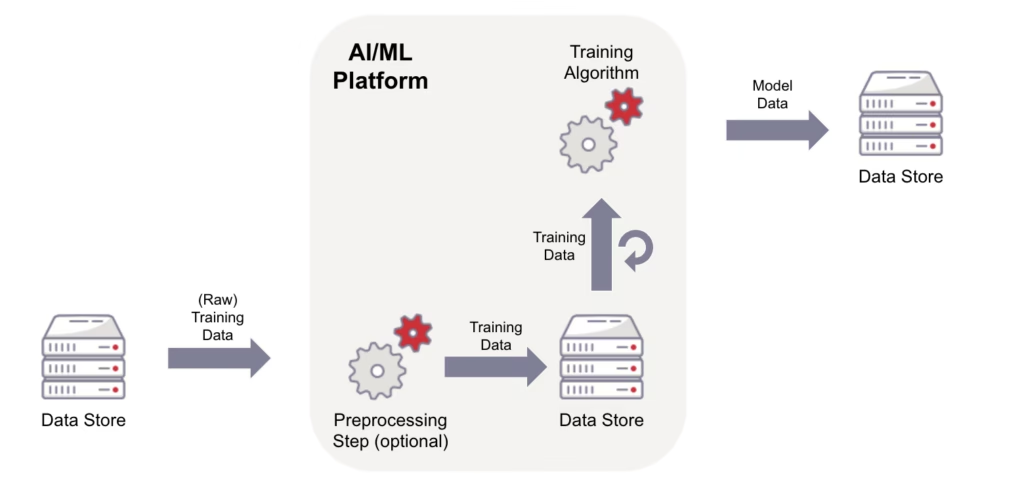

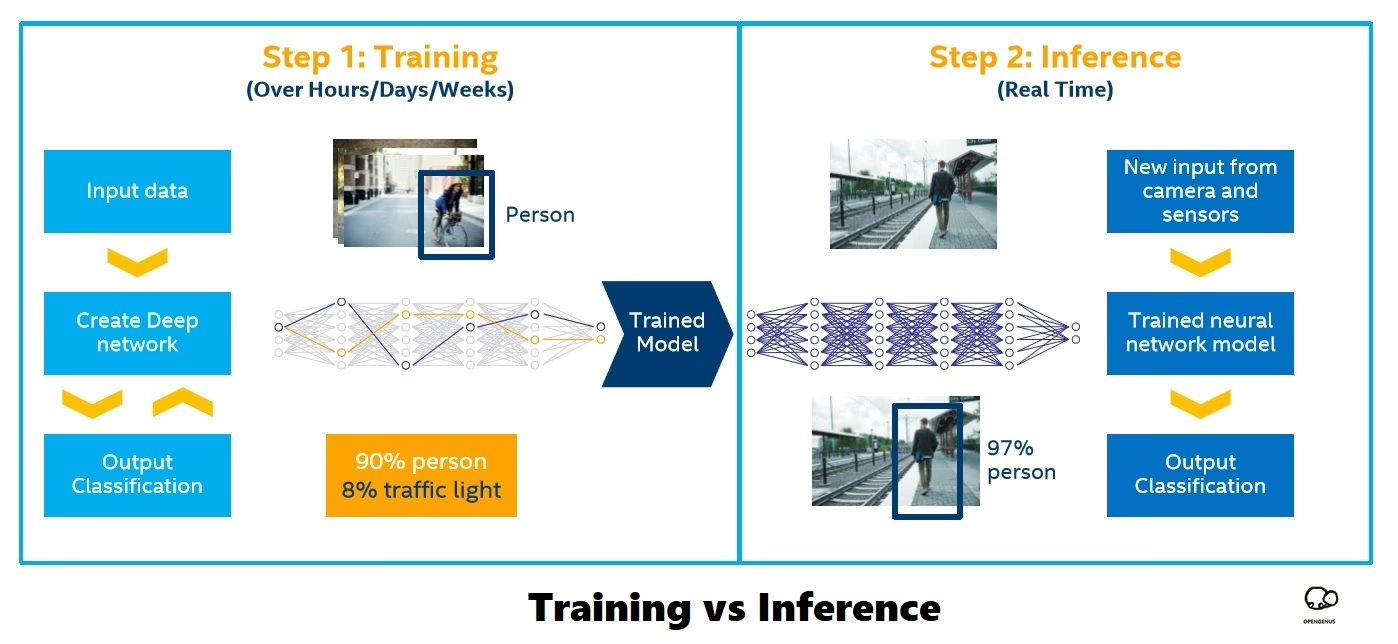

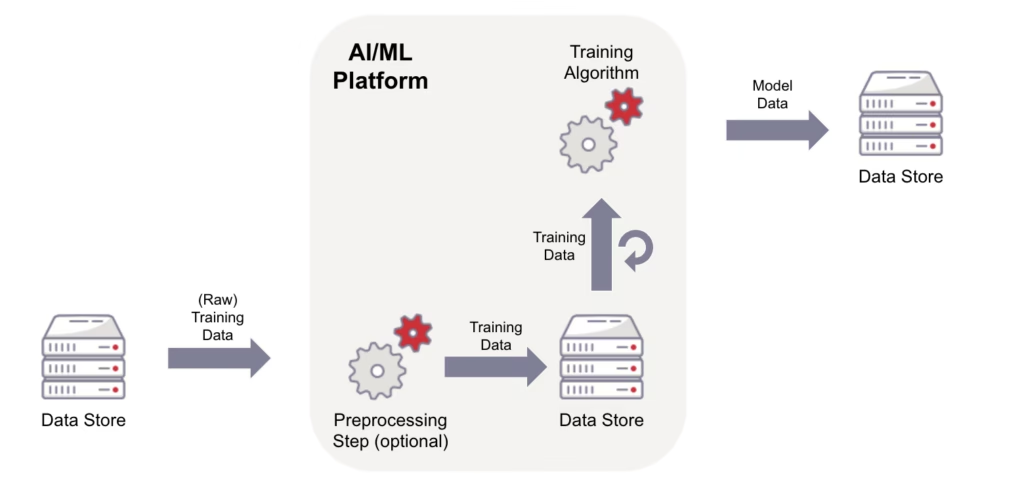

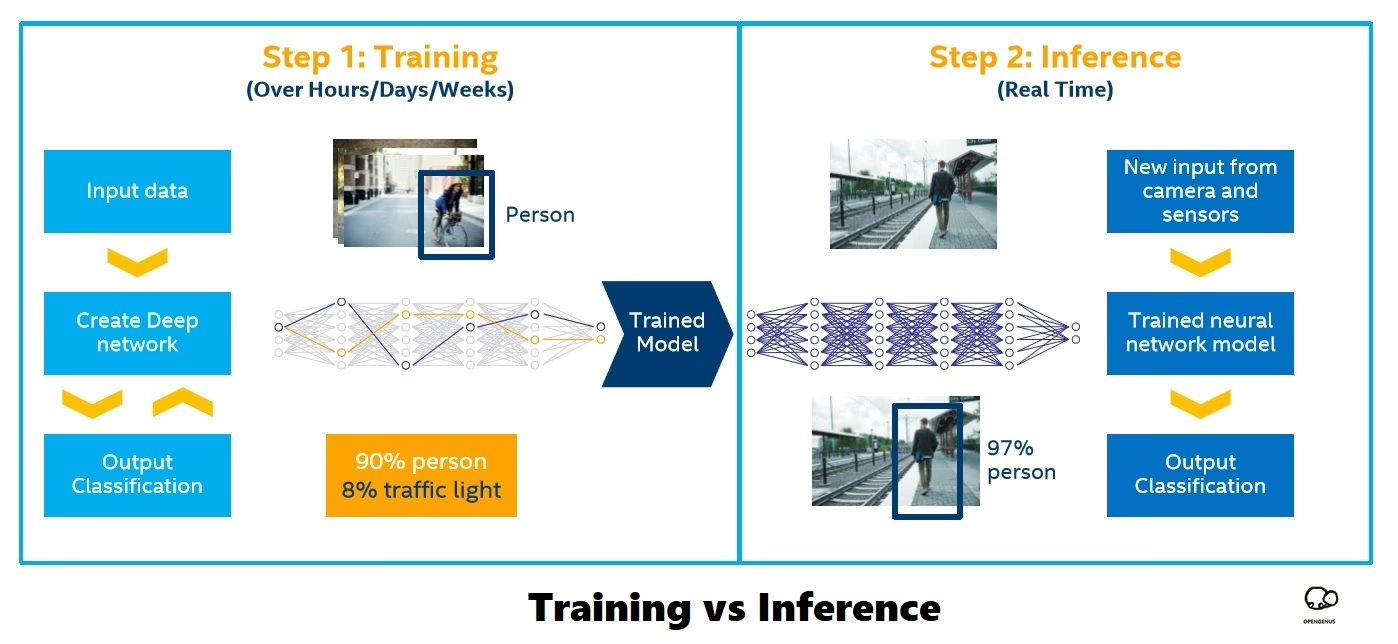

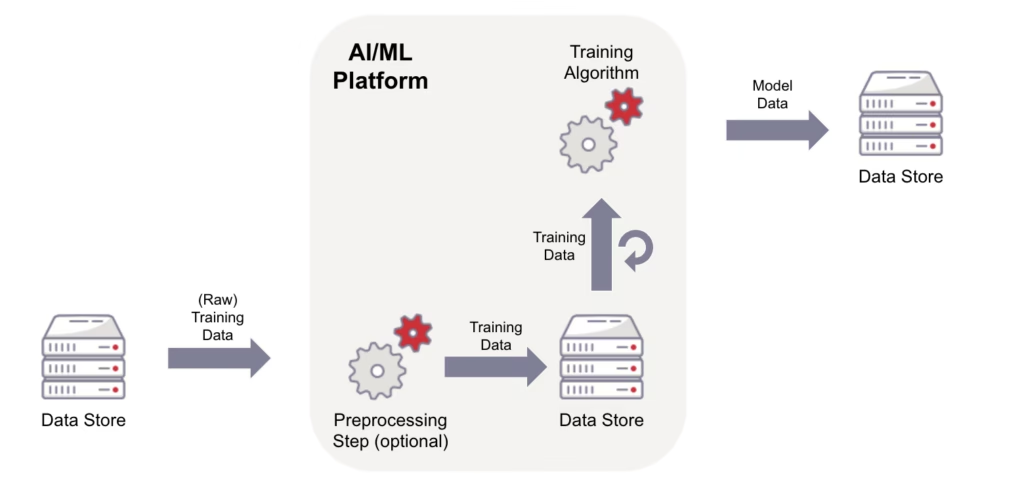

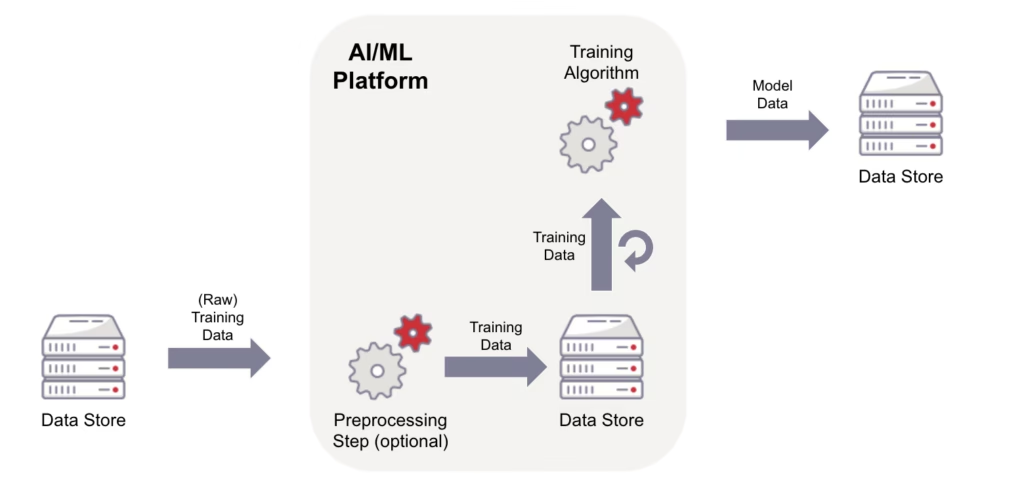

Antrenamentul unui algoritm de inteligență artificială este procesul prin care un model de bază este „învățat” să ia decizii corecte. Acest lucru se realizează prin alimentarea modelului cu cantități masive de date, cunoscute sub numele de set de date de antrenament. Pe parcursul acestui proces, modelul ajustează continuu parametrii săi interni pentru a identifica modele, relații și caracteristici relevante în date.

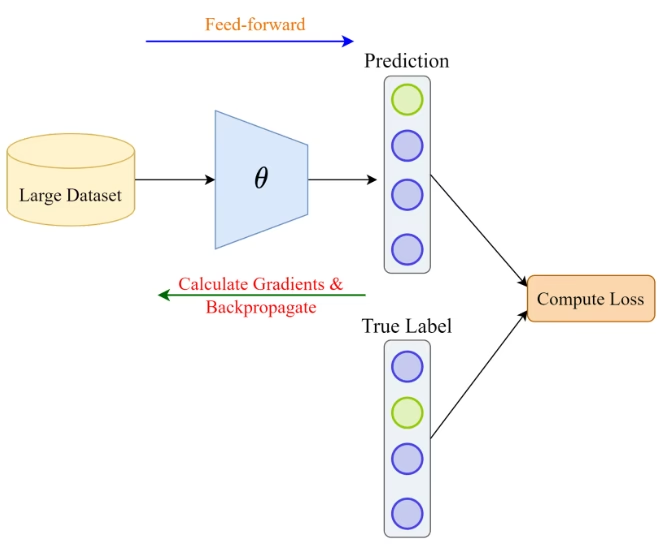

Imaginați-vă că doriți să antrenați un model AI să recunoască pisici și câini în imagini. Îi veți oferi milioane de imagini etichetate corespunzător (unele cu pisici, altele cu câini). Modelul va analiza fiecare imagine, va încerca să identifice caracteristicile distinctive (forme de urechi, blană, cozi) și va ajusta ponderile interne ale rețelei sale neuronale. Dacă inițial confundă o pisică cu un câine, va „învăța” din greșeală și își va rafina parametrii pentru a face predicții mai precise în viitor. Acest proces iterativ de ajustare a parametrilor, bazat pe feedback (de obicei, diferența dintre predicția sa și răspunsul corect), este esențial pentru învățarea modelului.

Hiperparametri și Parametri

În timpul antrenamentului, este important să înțelegem distincția dintre hiperparametri și parametri:

- Parametrii: Aceștia sunt valorile interne ale modelului care sunt ajustate automat în timpul procesului de antrenament. Ei sunt rezultatul învățării modelului din date. De exemplu, ponderile conexiunilor într-o rețea neuronală sunt parametri.

- Hiperparametrii: Aceștia sunt parametri care sunt setați extern, înainte de începerea antrenamentului, și influențează modul în care modelul învață. Exemple includ rata de învățare (cât de mult se ajustează parametrii la fiecare pas), numărul de epoci (câte ori modelul parcurge întregul set de date de antrenament) sau arhitectura rețelei neuronale (numărul de straturi și neuroni). Alegerea corectă a hiperparametrilor este crucială pentru performanța modelului și necesită adesea experimentare.

Antrenamentul AI este un proces intens din punct de vedere computațional. Necesită resurse hardware semnificative, cum ar fi unități de procesare grafică (GPU-uri) sau unități de procesare tensorială (TPU-uri), capabile să efectueze un număr mare de operații paralele. Durata antrenamentului poate varia de la ore la săptămâni sau chiar luni, în funcție de complexitatea modelului și de volumul datelor noi.

| Aspect | Parametri | Hiperparametri |

|---|---|---|

| Definiție | Valori interne învățate de model din date. | Setări externe care configurează procesul de învățare. |

| Ajustare | Ajustați automat în timpul antrenamentului. | Setat manual de dezvoltator înainte de antrenament. |

| Exemple | Ponderile și bias-urile într-o rețea neuronală. | Rata de învățare, numărul de straturi, funcția de activare. |

Ce este Inferența AI?

Odată ce un model AI a fost antrenat și a învățat din date, el este gata să fie folosit în lumea reală. Această etapă de aplicare a cunoștințelor se numește inferență. Inferența este procesul prin care un model AI antrenat ia o intrare nouă, pe care nu a mai văzut-o înainte, și generează o predicție, o decizie sau o clasificare bazată pe modelele pe care le-a învățat în timpul antrenamentului.

Revenind la exemplul cu recunoașterea imaginilor: după ce modelul a fost antrenat să distingă pisicile de câini, în faza de inferență, îi veți arăta o fotografie nouă, pe care nu a văzut-o niciodată. Modelul va procesa imaginea folosind parametrii săi antrenați și va „inferența” dacă imaginea conține o pisică sau un câine. Nu mai învață, ci aplică pur și simplu ceea ce știe.

Inferența este tipică pentru aplicațiile în timp real sau aproape în timp real. Gândiți-vă la:

- Recunoașterea vocală: Când vorbiți cu un asistent virtual, modelul AI efectuează inferență pentru a transforma undele sonore în text.

- Sisteme de recomandare: Netflix sau Amazon utilizează inferența pentru a sugera filme sau produse pe baza istoricului dvs. de vizualizare/cumpărare.

- Mașini autonome: Senzorii colectează date despre mediu, iar modelele AI efectuează inferență pentru a detecta obstacole, semne de circulație și pietoni.

- Generarea de conținut: Un chatbot precum ChatGPT efectuează inferență pentru a genera răspunsuri coerente și relevante la întrebările utilizatorilor.

Spre deosebire de antrenament, inferența este, în general, mult mai puțin intensivă din punct de vedere computațional. Deși viteza și eficiența sunt cruciale (mai ales pentru aplicațiile în timp real), inferența poate rula pe hardware mai puțin puternic, cum ar fi unități centrale de procesare (CPU-uri) sau chiar pe dispozitive periferice (edge devices), cum ar fi telefoanele mobile sau camerele inteligente.

De ce nu continuă modelul să învețe în timpul inferenței?

Deși ar putea părea intuitiv ca un model să continue să învețe pe măsură ce întâlnește date noi, în majoritatea cazurilor, separarea antrenamentului de inferență este esențială din mai multe motive:

- Eficiență: Antrenamentul este costisitor și consumă resurse. Realizarea unui antrenament continuu în timpul inferenței ar face sistemele ineficiente și costisitoare.

- Generalizare: Unul dintre obiectivele principale ale antrenamentului este ca modelul să generalizeze bine pe date noi, nevăzute. Dacă ar învăța continuu în timpul inferenței, ar putea începe să se „supra-adapteze” (overfit) la date specifice și să-și piardă capacitatea de a face predicții precise pe un set mai larg de date.

- Reproductibilitate și Stabilitate: În aplicațiile de producție, este vital ca rezultatele modelului să fie consistente și reproductibile. Dacă modelul ar învăța din mers, comportamentul său ar deveni imprevizibil, iar rezultatele ar varia de la o rulare la alta.

Există, desigur, excepții, cum ar fi sistemele de învățare continuă (continual learning) sau de învățare adaptivă (adaptive learning), unde modelele își actualizează periodic cunoștințele pe baza datelor noi, dar chiar și în aceste cazuri, actualizările sunt adesea controlate și nu reprezintă un antrenament complet în timp real la fiecare interacțiune.

Diferențe Cheie: Antrenament vs. Inferență

Pentru a rezuma, iată o comparație directă a celor două etape:

| Aspect | Antrenament AI | Inferență AI |

|---|---|---|

| Scop | Învățarea din date, optimizarea modelului. | Realizarea de predicții sau decizii pe baza cunoștințelor învățate. |

| Date utilizate | Seturi mari de date etichetate (sau neetichetate, în funcție de tipul de învățare). | Date noi, nevăzute anterior de model. |

| Intensitate Computațională | Foarte ridicată, necesită resurse mari. | Mai scăzută, dar necesită viteză și latență redusă. |

| Durată | De la ore la săptămâni/luni. | Milisecunde, aproape în timp real. |

| Hardware tipic | GPU-uri, TPU-uri, clustere de calcul. | CPU-uri, GPU-uri (pentru aplicații rapide), dispozitive edge. |

| Adaptabilitate | Modelul se adaptează continuu la datele de antrenament. | Parametrii modelului sunt fixați (cu excepția unor cazuri speciale de învățare adaptivă). |

| Costuri | Costuri inițiale ridicate pentru dezvoltare și infrastructură. | Costuri operaționale continue, influențate de volumul cererilor. |

De Ce Este Important să Înțelegem Ambele?

Înțelegerea profundă a diferențelor dintre antrenament și inferență este crucială pentru succesul oricărui proiect AI. Iată de ce:

- Alocarea Resurselor: Cunoașterea cerințelor specifice ale fiecărei faze permite o alocare optimă a resurselor hardware și software. Nu are sens să folosești un supercomputer pentru inferență dacă un server mai mic este suficient, la fel cum nu poți antrena un model complex pe un calculator obișnuit.

- Costuri și Eficiență Economică: Antrenamentul este adesea cea mai costisitoare parte a ciclului de viață al unui model AI. Optimizarea procesului de antrenament și minimizarea numărului de re-antrenamente pot reduce semnificativ cheltuielile. Pe de altă parte, deși inferența este mai puțin costisitoare per solicitare, volumul mare de cereri în aplicațiile de producție poate duce la costuri cumulate substanțiale. Optimizarea modelului pentru inferență rapidă și eficientă este esențială pentru controlul cheltuielilor pe termen lung.

- Scalabilitate: Capacitatea de a scala o aplicație AI depinde în mare măsură de faza de inferență. Un model bine antrenat trebuie să poată procesa rapid un număr mare de solicitări simultane, ceea ce este critic pentru aplicații la scară largă, cum ar fi chatbot-urile de servicii pentru clienți sau sistemele de analiză predictivă. O bună înțelegere a inferenței permite proiectarea unor sisteme robuste și performante.

- Îmbunătățire Continuă și Mentenanță: Modelele AI nu sunt statice. Pe măsură ce apar date noi, tendințele se schimbă sau cerințele se modifică, modelele pot necesita re-antrenare. Înțelegerea momentului și a modului de a re-antrena un model, fără a perturba faza de inferență activă, este vitală pentru menținerea relevanței și preciziei modelului în timp.

- Dezvoltare și Implementare: Echipele de dezvoltare AI trebuie să aibă expertiză în ambele domenii. Inginerii de machine learning se concentrează adesea pe antrenament și optimizarea modelului, în timp ce inginerii MLOps (Machine Learning Operations) se ocupă de implementarea, monitorizarea și scalabilitatea inferenței în mediile de producție.

Întrebări Frecvente (FAQ)

Ce este o rețea neuronală în contextul AI?

O rețea neuronală este un tip de algoritm de învățare automată inspirat de structura creierului uman. Este alcătuită din straturi interconectate de „neuroni” artificiali care procesează informațiile. Fiecare conexiune are o „pondere” care se ajustează în timpul antrenamentului, permițând rețelei să învețe modele complexe din date și să facă predicții.

Poate un model AI să învețe în timpul inferenței?

În general, nu. Faza de inferență este dedicată aplicării cunoștințelor învățate. Deși există concepte avansate precum învățarea continuă sau adaptivă, în majoritatea aplicațiilor practice, modelul nu își modifică parametrii în timpul inferenței pentru a asigura stabilitatea, reproductibilitatea și eficiența.

Ce tip de date sunt folosite pentru antrenament și inferență?

Pentru antrenament, se folosesc seturi mari de date istorice, care pot fi etichetate (pentru învățarea supervizată) sau neetichetate (pentru învățarea nesupervizată). Acestea pot include imagini, text, sunet, date numerice etc. Pentru inferență, se folosesc date noi, în timp real, pe care modelul nu le-a mai văzut în timpul antrenamentului, dar pe care trebuie să le proceseze și să le clasifice sau să le prezică.

De ce antrenamentul este mai intensiv computațional decât inferența?

Antrenamentul implică milioane sau miliarde de calcule pentru a ajusta parametrii modelului, parcurgând datele de mai multe ori și minimizând erorile. Inferența, pe de altă parte, este un proces de „trecere înainte” (forward pass), unde datele traversează rețeaua o singură dată pentru a produce o predicție, fără a modifica parametrii modelului.

Este posibil să rulez inferența pe un dispozitiv mic, cum ar fi un telefon?

Da, este absolut posibil! Aceasta este o tendință numită „AI la periferie” (Edge AI). Modelele AI pot fi optimizate și „comprimate” pentru a rula eficient pe dispozitive cu resurse limitate, cum ar fi smartphone-uri, camere de securitate sau senzori inteligenți, permițând răspunsuri rapide și reducând dependența de conectivitatea la cloud.

Concluzie

Antrenamentul și inferența sunt cele două piloni pe care se bazează funcționarea sistemelor de inteligență artificială. Antrenamentul este faza de învățare intensă, unde modelul dobândește cunoștințe din date masive, în timp ce inferența este etapa de aplicare a acestor cunoștințe pentru a rezolva probleme concrete în lumea reală. Înțelegerea clară a acestor diferențe nu este doar o chestiune de terminologie, ci o necesitate strategică pentru oricine dorește să construiască, să implementeze sau să utilizeze eficient soluții bazate pe inteligență artificială. Prin optimizarea ambelor procese, putem debloca întregul potențial al AI și putem crea sisteme mai inteligente, mai eficiente și mai relevante pentru nevoile noastre.

Dacă vrei să descoperi și alte articole similare cu Antrenament și Inferență AI: Diferențe Esențiale, poți vizita categoria Fitness.