04/06/2022

În lumea rapidă a inteligenței artificiale și a analizei datelor, XGBoost (Extreme Gradient Boosting) a devenit rapid un instrument indispensabil pentru modelarea predictivă. Recunoscut pentru viteza, flexibilitatea și performanța sa excepțională, XGBoost este alegerea preferată a multor profesioniști pentru o gamă largă de sarcini, de la clasificare binară la regresie complexă. Această metodă puternică de învățare automată, bazată pe arbori de decizie, excelează în gestionarea seturilor de date structurate și sparse, oferind rezultate de vârf în diverse domenii. Dar pentru a debloca pe deplin potențialul său, este crucial să înțelegem nu doar cum funcționează, ci și cum să-l adaptăm nevoilor specifice ale datelor noastre. Acest articol vă va ghida prin aspecte fundamentale și avansate ale utilizării XGBoost, acoperind trei teme esențiale: antrenarea modelelor cu ponderări pe eșantion, reluarea antrenamentului pentru o dezvoltare iterativă eficientă și, cel mai important, o analiză detaliată a parametrilor săi cheie, care vă permit să reglați fin modelul pentru performanțe optime. Pregătiți-vă să duceți abilitățile de modelare la nivelul următor!

- Antrenarea Modelului XGBoost cu Ponderări pe Eșantion (Sample Weights)

- Reluarea Antrenamentului unui Model XGBoost Existent

- O Privire Detaliată Asupra Parametrilor XGBoost

- Implementare Practică: Un Exemplu de Clasificare cu XGBoost

- De Ce se Numește XGBoost?

- Aplicații Comunitare ale XGBoost

- Avantajele și Dezavantajele XGBoost

- Întrebări Frecvente (FAQ)

Antrenarea Modelului XGBoost cu Ponderări pe Eșantion (Sample Weights)

Unul dintre scenariile cele mai provocatoare în învățarea automată este lucrul cu seturi de date dezechilibrate, unde o clasă este mult mai puțin reprezentată decât alta. În astfel de cazuri, un model obișnuit poate tinde să ignore clasa minoritară, deoarece optimizarea sa se concentrează pe acuratețea generală, care este dominată de clasa majoritară. XGBoost oferă o soluție elegantă la această problemă prin permiterea atribuirii de ponderări diferite fiecărui eșantion de antrenament. Această funcționalitate este extrem de utilă nu doar pentru seturi de date dezechilibrate, ci și atunci când doriți ca anumite eșantioane să aibă o influență mai mare asupra procesului de învățare al modelului, reflectând importanța lor intrinsecă sau costul erorilor asociate.

Prin atribuirea unei ponderări mai mari eșantioanelor din clasa minoritară, forțăm modelul să acorde o atenție sporită acestora, învățând să le clasifice mai bine. Acest lucru poate duce la o îmbunătățire semnificativă a metricilor de performanță relevante pentru clasele minoritare, cum ar fi precizia, rechemarea sau scorul F1, care sunt adesea mai informative decât acuratețea simplă într-un context dezechilibrat.

Să ne imaginăm un scenariu practic: generăm un set de date de clasificare binară puternic dezechilibrat, unde 90% din eșantioane aparțin clasei 0 și doar 10% clasei 1. Fără ponderări, un model XGBoost ar putea clasifica majoritatea eșantioanelor ca fiind clasa 0, obținând o acuratețe aparent bună, dar eșuând lamentabil în detectarea clasei minoritare (clasa 1). Prin aplicarea ponderărilor, putem atribui o pondere de, să zicem, 10 eșantioanelor din clasa 1 și o pondere de 1 eșantioanelor din clasa 0. Acest lucru semnalează algoritmului că o eroare pe un eșantion din clasa 1 este de 10 ori mai "costisitoare" decât o eroare pe un eșantion din clasa 0. Astfel, modelul va ajusta limitele de decizie pentru a minimiza aceste erori cu ponderare mare, îmbunătățind capacitatea sa de a identifica eșantioanele din clasa minoritară.

Implementarea acestei caracteristici în XGBoost, în special prin API-ul scikit-learn, este directă. După ce v-ați pregătit datele și le-ați împărțit în seturi de antrenament și testare, tot ce trebuie să faceți este să creați un array de ponderări pe eșantion. Acest array trebuie să aibă aceeași lungime ca și setul de date de antrenament, iar fiecare element să corespundă ponderii dorite pentru eșantionul respectiv. Apoi, acest array este pur și simplu pasat metodei fit() a modelului XGBoost prin parametrul sample_weight. Este un pas mic, dar cu un impact major asupra robustezii și relevanței modelului, mai ales în aplicații critice unde detectarea claselor minoritare este vitală, cum ar fi depistarea fraudelor sau diagnosticarea bolilor rare.

Reluarea Antrenamentului unui Model XGBoost Existent

Dezvoltarea modelelor de învățare automată este adesea un proces iterativ. Nu este neobișnuit să antrenați un model pentru un anumit număr de iterații, să evaluați performanța, să faceți ajustări și apoi să doriți să continuați antrenamentul de unde ați rămas. Acest lucru este extrem de util pentru modele complexe care necesită mult timp de antrenament sau când lucrați cu resurse limitate. XGBoost facilitează acest proces prin capacitatea sa de a salva un model antrenat pe disc și de a-l încărca ulterior pentru a relua antrenamentul.

Această caracteristică de învățare iterativă permite dezvoltatorilor să gestioneze eficient timpul și resursele. Puteți antrena un model pentru o perioadă, să-l salvați, să închideți sesiunea de lucru, iar apoi, la o dată ulterioară, să încărcați modelul salvat și să continuați antrenamentul exact de unde ați rămas, adăugând mai mulți estimatori (arbori) la ansamblul existent. Acest lucru este mult mai eficient decât a reîncepe antrenamentul de la zero, mai ales pentru modele cu un număr mare de estimatori sau pentru seturi de date voluminoase.

Procesul implică câțiva pași simpli. Mai întâi, după ce ați antrenat modelul inițial pentru un anumit număr de runde (de exemplu, 50 de estimatori), îl salvați pe disc folosind metoda save_model(), specificând un nume de fișier (de exemplu, "model.json"). Această operațiune serializează starea curentă a modelului, inclusiv toți arborii construiți până în acel moment și parametrii asociați.

Pentru a relua antrenamentul, creați o nouă instanță a clasei XGBoost (XGBClassifier sau XGBRegressor, în funcție de sarcina dumneavoastră) și încărcați modelul salvat în această nouă instanță utilizând metoda load_model(). Acum, această nouă instanță conține toate cunoștințele acumulate de modelul anterior.

Punctul cheie pentru reluarea antrenamentului este utilizarea parametrului xgb_model în metoda fit(). În loc să antrenați un model complet nou, îi spuneți metodei fit() să continue antrenamentul pe baza unui model existent. Pentru a face acest lucru, trebuie să-i pasați obiectul "booster" subiacent al modelului încărcat. Acest lucru se realizează prin apelarea metodei get_booster() pe instanța modelului încărcat (de exemplu, model_incarcat.get_booster()). Când apelați fit() cu xgb_model specificat, XGBoost va adăuga estimatori suplimentari la ansamblul existent, în loc să construiască un ansamblu complet nou.

Această capacitate de a relua antrenamentul este un avantaj semnificativ al XGBoost, permițând un flux de lucru flexibil și eficient pentru explorarea și optimizarea modelelor, fără a pierde progresul realizat.

O Privire Detaliată Asupra Parametrilor XGBoost

XGBoost (Extreme Gradient Boosting) este un cadru de boosting bazat pe gradient, scalabil, eficient și flexibil. Acesta utilizează arbori de decizie ca învățători de bază și funcționează pe principiul arborilor de decizie de boosting de gradient (GBDT). Este utilizat pe scară largă atât pentru sarcini de regresie, cât și de clasificare și are o eficiență ridicată în ceea ce privește viteza și performanța. Funcționează atât pe date structurate/tabulare, cât și pe date sparse.

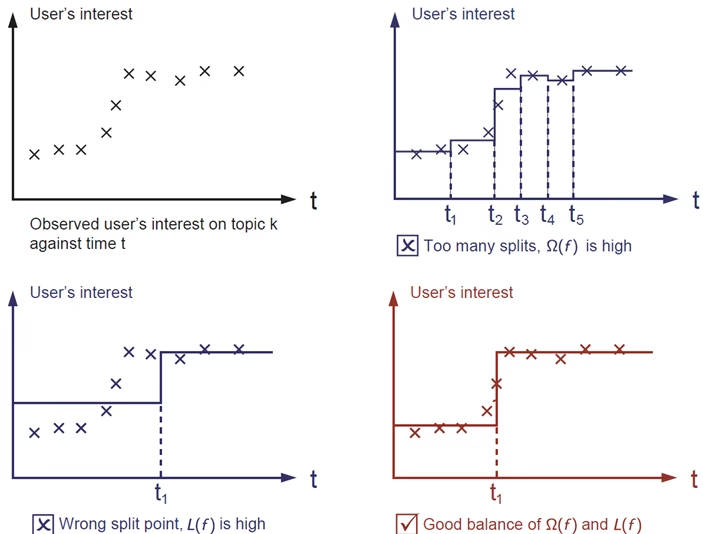

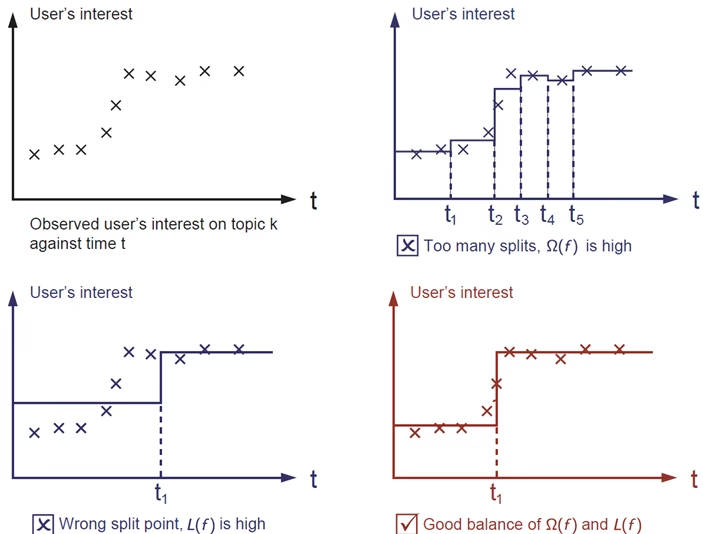

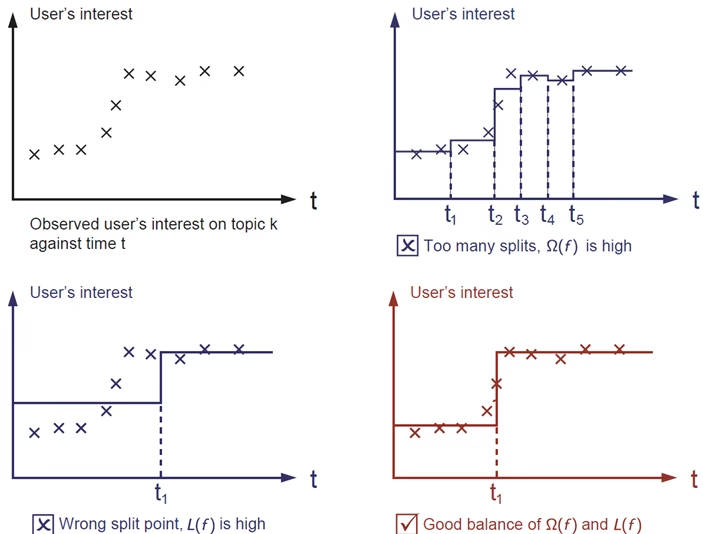

Principiul de Funcționare: XGBoost minimizează o funcție obiectiv regularizată. Adaugă arbori secvențial pentru a minimiza pierderea. Construiește arbori la nivel de nivel și utilizează aproximarea Taylor de ordinul doi pentru optimizare.

Caracteristici Cheie ale XGBoost și Rolul Parametrilor:

- Model de ansamblu bazat pe arbori de decizie.

- Regularizare (L1 și L2) pentru a reduce supraînvățarea.

- Oprirea timpurie (early stopping) asigură eficiența modelului în timp.

- Schița cu quantile ponderate pentru o mai bună împărțire a arborilor.

- Calcul paralel, antrenament out-of-core îl face rapid.

- Suportă diverse obiective: regresie, clasificare, clasificare.

Tipuri de Parametri XGBoost:

Parametrii XGBoost sunt clasificați în trei tipuri principale: Parametri Generali, Parametri Booster și Parametri pentru Sarcina de Învățare. Fiecare grup îmbunătățește modelul într-un mod diferit, cum ar fi configurarea algoritmului de boosting sau comportamentul de învățare al modelului.

1. Parametri Generali:

Acești parametri definesc configurația generală și resursele pentru rularea XGBoost. Aceștia includ decizii precum ce booster (arbore, model liniar etc.) să utilizeze, cât de multă verbositate să permită în timpul antrenamentului sau dacă ar trebui utilizat GPU. Exemple: booster='gbtree', verbosity=1.

booster: Specifică tipul de booster de utilizat. Poate lua valori precum 'gbtree' (pentru modele bazate pe arbori), 'gblinear' (pentru modele liniare) și 'dart' (Dropouts meet Multiple Additive Regression Trees). Implicit este 'gbtree', cel mai utilizat în practică, oferind cele mai bune performanțe pentru majoritatea seturilor de date. Alegerea 'gblinear' este utilă pentru date cu dimensionalitate foarte mare sau când se dorește un model mai interpretabil.verbosity: Controlează cantitatea de informații afișate în timpul antrenamentului. Poate lua valori 0 (silence), 1 (warning), 2 (info) și 3 (debug). Este util pentru monitorizarea sau depanarea procesului de antrenament. O valoare mai mare oferă feedback mai detaliat despre progresul antrenamentului, dar poate fi prea mult pentru rulări de producție.nthreadsaun_jobs: Setează numărul de fire de execuție utilizate pentru rularea XGBoost. Dacă nu este setat, XGBoost utilizează toate nucleele disponibile. Este important pentru controlul resurselor de calcul în modele mari, permițând paralelizarea eficientă a construirii arborilor.random_statesauseed: Asigură reproductibilitatea prin setarea seminței aleatoare pentru amestecare și eșantionare. Ajută la compararea rulărilor modelului cu aceleași date, asigurând că rezultatele sunt consistente între diferite execuții.

2. Parametri Booster:

Acești parametri determină modul în care fiecare arbore sau model este construit în fiecare rundă de boosting. Aceștia includ parametri specifici modelelor bazate pe arbori, cum ar fi max_depth, min_child_weight și subsample. Ei determină complexitatea fiecărui arbore, strategia de regularizare și modul în care sunt eșantionate datele.

eta(learning_rate): Controlează dimensiunea pasului de contracție pentru contribuția fiecărui arbore, variind de la 0.01 la 0.3. Valori mai mici creează modele mai robuste, dar necesită un antrenament mai lung, în timp ce valori mai mari accelerează antrenamentul, dar riscă supraînvățarea. O valoare mică forțează modelul să învețe în pași mai mici, ceea ce poate duce la o convergență mai stabilă și la o generalizare mai bună.max_depth: Setează adâncimea maximă a arborelui, de obicei între 3-10, echilibrând complexitatea și supraînvățarea. Arborii mai adânci captează modele complexe, dar supraînvăță ușor, în timp ce arborii mai puțin adânci sunt mai conservatori, dar pot subînvăța. Reducerea adâncimii este o formă eficientă de regularizare.alpha(reg_alpha): Regularizare L1 pe ponderile frunzelor, promovând raritatea prin forțarea unor ponderi la zero. Valori mai mari cresc puterea de regularizare și efectuează selecția de caracteristici la nivel de frunză. Este utilă atunci când aveți multe caracteristici și doriți să reduceți complexitatea modelului.lambda(reg_lambda): Regularizare L2 pe ponderile frunzelor, netezind ponderile fără a promova raritatea. Valoarea implicită este 1, cu valori mai mari creând modele mai conservatoare și stabile, rezistente la zgomot. L2 este mai blândă decât L1, distribuind efectul de regularizare pe toate ponderile.gamma(min_split_loss): Reducerea minimă a pierderii necesară pentru împărțirile arborelui, cu valoarea implicită 0. Valori mai mari creează arbori conservatori prin asigurarea că apar doar împărțiri semnificative, acționând ca o regularizare. O valoare mai mare de gamma înseamnă că algoritmul va fi mai selectiv în adăugarea de noi ramuri, prevenind împărțirile care aduc beneficii minime.subsample: Fracția de eșantioane de antrenament eșantionate aleatoriu pentru a construi fiecare arbore. Valori tipice între 0.5 și 1.0. Utilizarea subsampling-ului ajută la reducerea supraînvățării prin introducerea varianței și prin limitarea expunerii fiecărui arbore la întregul set de date.colsample_bytree: Fracția de caracteristici eșantionate aleatoriu pentru a construi fiecare arbore. Similar cu subsample, dar aplicat la coloane (caracteristici). Ajută la prevenirea supraînvățării și la reducerea corelației dintre arbori.

Comparație Regularizare L1 vs L2:

| Caracteristică | Regularizare L1 (reg_alpha) | Regularizare L2 (reg_lambda) |

|---|---|---|

| Efect Principal | Promovează raritatea (face unele ponderi zero) | Netezește ponderile (le reduce spre zero, dar rar le face zero) |

| Selecția Caracteristicilor | Implicită, poate elimina caracteristici | Nu realizează selecția caracteristicilor |

| Sensibilitate la Outlieri | Mai robustă | Mai puțin robustă |

| Utilizare Tipică | Când se dorește un model mai simplu, cu mai puține caracteristici | Când se dorește un model mai stabil, pentru a preveni supraînvățarea generală |

3. Parametri pentru Sarcina de Învățare:

Acești parametri definesc tipul problemei, funcția de pierdere și abordarea de evaluare. Ei determină ce tip de sarcină de învățare rezolvați (de exemplu, clasificare binară, clasificare multi-clasă, regresie) și cum este evaluată performanța în timpul antrenamentului.

objective: Definește sarcina de învățare și funcția de pierdere, cum ar fireg:squarederrorpentru regresie saubinary:logisticpentru clasificare. Alegerea impactează semnificativ comportamentul modelului, viteza de convergență și rezultatele performanței. Este cel mai important parametru pentru a seta tipul problemei pe care o rezolvați.eval_metric: Metrica de evaluare pentru monitorizarea progresului antrenamentului, cum ar firmsepentru regresie sauaucpentru clasificare. Pot fi specificate mai multe metrici simultan pentru o evaluare cuprinzătoare a performanței. Această metrică este utilizată pentru oprirea timpurie și pentru a afișa progresul.num_class: Numărul de clase pentru clasificarea multi-clasă, necesar pentru obiective precummulti:softmax. Ar trebui să fie egal cu numărul total de clase unice din setul de date și este ignorat pentru clasificarea binară și regresie.scale_pos_weight: Un parametru crucial pentru date dezechilibrate. Este raportul dintre numărul de eșantioane negative și cel de eșantioane pozitive (count(negative examples) / count(positive examples)). Ajută la gestionarea dezechilibrului claselor prin acordarea unei ponderi mai mari clasei pozitive (minoritară), similar cusample_weight, dar aplicat la nivel de clasă. O valoare de 1 înseamnă că nu se aplică nicio ajustare.tree_method: Algoritmul pentru construirea arborelui, afectând viteza și utilizarea memoriei. Opțiunile includexactpentru precizie,histpentru viteză pe seturi de date mari șigpu_histpentru accelerare GPU. Alegerea corectă poate reduce semnificativ timpul de antrenament.

Parametri Semnificativi Adesea Ajustați (Tuning):

În timpul optimizării unui model XGBoost, următorii parametri sunt adesea cei mai importanți de reglat pentru a obține cele mai bune performanțe și pentru a preveni supraînvățarea:

learning_rate(saueta): Cât de repede învață modelul.max_depth: Complexitatea fiecărui arbore.n_estimators: Numărul total de arbori din ansamblu.subsample: Fracția de date utilizată pentru fiecare arbore.colsample_bytree: Fracția de caracteristici utilizate pentru fiecare arbore.reg_alpha(L1) șireg_lambda(L2): Forța regularizării.gamma: Pragul de pierdere pentru împărțirea nodurilor.scale_pos_weight: Pentru gestionarea dezechilibrului de clasă.early_stopping_rounds: Oprește antrenamentul devreme dacă nu există îmbunătățiri.

Implementare Practică: Un Exemplu de Clasificare cu XGBoost

Pentru a ilustra modul în care acești parametri sunt utilizați într-un context real, să considerăm un exemplu simplu de clasificare. Procesul tipic de implementare a unui model XGBoost implică câțiva pași cheie:

- Pregătirea Datelor: Începem prin încărcarea unui set de date (de exemplu, setul de date Breast Cancer din scikit-learn, care este potrivit pentru clasificare binară). Aceste date sunt apoi împărțite în seturi de antrenament și testare, asigurându- ne că modelul este evaluat pe date pe care nu le-a "văzut" în timpul antrenamentului. O împărțire comună este 80% pentru antrenament și 20% pentru testare.

- Construirea și Antrenarea Modelului: Se inițializează un obiect

XGBClassifier(sauXGBRegressorpentru regresie) și se configurează cu parametrii doriți. Parametri precumobjective(pentru a specifica tipul sarcinii, de exemplu,'binary:logistic'pentru clasificare binară),n_estimators(numărul de arbori),max_depth,learning_rate,subsampleșicolsample_bytreesunt adesea setați la valori inițiale. Metodafit()este apoi apelată, pasându-i setul de date de antrenament și etichetele corespunzătoare. În timpul acestui proces, XGBoost construiește secvențial arbori, ajustându-și predicțiile pentru a minimiza funcția de pierdere. - Realizarea Predicțiilor și Evaluarea: După antrenare, modelul este utilizat pentru a face predicții pe setul de date de testare. Aceste predicții sunt apoi comparate cu etichetele reale ale setului de testare pentru a evalua performanța modelului. Metricile comune de evaluare pentru clasificare includ acuratețea (

accuracy_score), precizia, rechemarea, scorul F1 sau AUC (Area Under the Curve). O acuratețe de, să zicem, 96.5% indică o performanță robustă a modelului pe datele nevăzute.

Acest proces iterativ de antrenare, evaluare și ajustare a parametrilor este esențial pentru a construi modele XGBoost de înaltă performanță.

De Ce se Numește XGBoost?

Termenul "XG" din XGBoost provine de la "eXtreme Gradient Boosting". Această denumire subliniază optimizările semnificative aduse algoritmului original de gradient boosting. Aceste optimizări includ, dar nu se limitează la, tehnici avansate de regularizare pentru a preveni supraînvățarea, o abordare inteligentă de tăiere a arborilor (pruning), capacitatea de a rula în paralel pe mai multe nuclee de procesor și optimizări pentru gestionarea memoriei cache. Toate aceste îmbunătățiri contribuie la o performanță "extremă" în ceea ce privește viteza de antrenament și acuratețea predicțiilor, făcând XGBoost un instrument de top în arsenalul oricărui specialist în date.

Aplicații Comunitare ale XGBoost

Versatilitatea și performanța superioară a XGBoost l-au făcut popular într-o multitudine de domenii:

- Sănătate: Predicția bolilor, identificarea factorilor de risc, optimizarea tratamentelor. De exemplu, poate fi folosit pentru a prezice riscul de a dezvolta o anumită afecțiune pe baza istoricului medical al pacientului.

- Finanțe: Detectarea fraudelor, scoruri de credit, predicția prețurilor acțiunilor. Capacitatea sa de a gestiona date dezechilibrate este crucială în detectarea tranzacțiilor frauduloase, care sunt evenimente rare.

- Marketing: Segmentarea clienților, predicția ratei de abandon (churn prediction), recomandări de produse. Ajută companiile să înțeleagă comportamentul clienților și să personalizeze strategiile de marketing.

- Procesarea Limbajului Natural (NLP): Sarcini de clasificare a textului, analiză de sentiment. Deși nu este un model nativ pentru text, poate fi utilizat pe reprezentări numerice ale textului (embeddings) pentru sarcini de clasificare.

- E-commerce: Sisteme de recomandare, optimizarea prețurilor, predicția cererii.

- Jocuri: Crearea de AI pentru jocuri, predicția rezultatelor.

Avantajele și Dezavantajele XGBoost

Ca orice algoritm complex, XGBoost vine cu propriul set de avantaje și dezavantaje:

Avantaje:

- Rapid și Scalabil: Optimizările interne permit antrenarea rapidă pe seturi de date mari, chiar și cu milioane de eșantioane.

- Regularizare Robustă: Mecanismele L1 și L2, împreună cu

gammașisubsample, previn eficient supraînvățarea. - Tăierea Arborilor (Tree Pruning): Elimină ramurile inutile, optimizând modelul și reducând complexitatea.

- Validare Încrucișată și Oprire Timpurie (Early Stopping): Funcționalități încorporate care permit o evaluare robustă a modelului și oprirea antrenamentului atunci când nu se mai înregistrează îmbunătățiri, economisind resurse.

- Excelent pentru Date Tabulare/Structurate: Performanță de top pe acest tip de date, unde majoritatea problemelor de afaceri sunt întâlnite.

- Flexibil: Suportă o gamă largă de funcții obiectiv și metrici de evaluare.

Dezavantaje:

- Mai Puțin Interpretativ: Comparativ cu modele mai simple (cum ar fi regresia liniară sau arborii de decizie unici), interpretarea contribuției individuale a caracteristicilor poate fi mai dificilă din cauza naturii sale de ansamblu.

- Poate Supraînvăța dacă nu este Reglat Corect: Deși are mecanisme de regularizare, o configurare incorectă a parametrilor (ex:

max_depthprea mare,learning_rateprea mare) poate duce la supraînvățare. - Reglarea Parametrilor Consumă Timp: Găsirea combinației optime de parametri necesită adesea experimentare extinsă (tuning de hiperparametri), care poate fi consumatoare de timp și resurse.

- Mai Puțin Eficient pentru Date de Imagine/Audio: Nu este conceput ca un algoritm de învățare profundă și nu este la fel de eficient pentru date nestructurate, cum ar fi imagini sau audio, unde rețelele neuronale convoluționale sau recurente sunt mai potrivite.

Întrebări Frecvente (FAQ)

Pentru a clarifica și mai mult aspectele legate de XGBoost, iată câteva întrebări frecvente:

- Q: Când ar trebui să folosesc ponderări pe eșantion (sample weights) în XGBoost?

- A: Ar trebui să utilizați ponderări pe eșantion în principal atunci când lucrați cu seturi de date dezechilibrate, unde o clasă este mult mai puțin reprezentată decât alta. Acest lucru ajută modelul să acorde o importanță mai mare clasei minoritare, îmbunătățind performanța pe aceasta. De asemenea, poate fi util dacă aveți anumite eșantioane de antrenament care sunt intrinsec mai importante sau mai fiabile.

- Q: Pot relua antrenamentul unui model XGBoost dacă schimb setul de date?

- A: Teoretic, da, dar cu precauție. Reluarea antrenamentului este menită să continue învățarea pe același set de date sau pe un set de date similar, adăugând mai mulți estimatori. Dacă schimbați semnificativ distribuția sau caracteristicile setului de date, este adesea mai bine să antrenați un model nou de la zero pentru a asigura că modelul învață corect noile pattern-uri.

- Q: Cum aleg cei mai buni parametri pentru modelul meu XGBoost?

- A: Alegerea celor mai buni parametri (tuning de hiperparametri) este crucială. Metode comune includ:

- Grid Search: Explorează sistematic toate combinațiile posibile dintr-un set predefinit de valori.

- Random Search: Eșantionează aleatoriu combinații de parametri, adesea mai eficient decât Grid Search pentru spații mari de parametri.

- Optimizare Bayesiană: Utilizează rezultatele anterioare pentru a ghida explorarea spațiului de parametri, fiind adesea cea mai eficientă metodă.

De asemenea, înțelegerea rolului fiecărui parametru (discutat mai sus) vă poate ghida în alegerea unor intervale de căutare rezonabile.

- Q: Este XGBoost potrivit pentru toate tipurile de date?

- A: XGBoost excelează pe date tabulare (structurate) și sparse, fiind o alegere de top pentru majoritatea problemelor de clasificare și regresie în aceste formate. Nu este însă ideal pentru date nestructurate, cum ar fi imagini, audio sau video, unde alte arhitecturi de învățare profundă (cum ar fi rețelele neuronale convoluționale sau recurente) sunt mult mai eficiente și specializate.

- Q: Care este diferența dintre

sample_weightșiscale_pos_weight? - A: Ambele sunt utilizate pentru a gestiona datele dezechilibrate, dar operează la niveluri diferite.

sample_weightpermite atribuirea unei ponderări individuale fiecărui eșantion din setul de antrenament. Este mai granular și oferă control total asupra influenței fiecărui punct de date.scale_pos_weighteste un singur parametru care ajustează ponderea clasei pozitive în raport cu clasa negativă în contextul clasificării binare. Este mai simplu de utilizat pentru dezechilibrul general al claselor, dar mai puțin flexibil decâtsample_weight.

În general,

sample_weighteste mai puternic și mai general, putând acoperi cazuri dincolo de simplul dezechilibru de clasă.

Sperăm că acest ghid detaliat v-a oferit o înțelegere aprofundată a capacităților XGBoost și a modului în care puteți manipula parametrii săi pentru a obține cele mai bune rezultate. Stăpânirea acestor tehnici vă va permite să construiți modele predictive mai robuste, mai precise și mai eficiente în diverse aplicații practice.

Dacă vrei să descoperi și alte articole similare cu XGBoost: Ponderări, Reluare & Parametri Esențiali, poți vizita categoria Fitness.