17/07/2022

În era digitală actuală, inteligența artificială (AI) a devenit un pilon fundamental al inovației, transformând modul în care interacționăm cu tehnologia și lumea înconjurătoare. La baza multor progrese din AI stau rețelele neurale, modele computaționale inspirate de complexitatea creierului uman. Aceste structuri interconectate permit mașinilor să învețe din date, să recunoască modele complexe și să efectueze predicții cu o precizie remarcabilă. De la recunoașterea imaginilor și procesarea limbajului natural, până la sistemele de recomandare și diagnosticare medicală, rețelele neurale sunt omniprezente, modelând viitorul tehnologiei.

Acest articol este dedicat explorării aprofundate a rețelelor neurale, demistificând conceptele lor fundamentale și oferind o perspectivă practică asupra modului în care acestea sunt construite și antrenate. Vom naviga prin arhitectura de bază a unei rețele neurale, vom înțelege rolul fiecărui component și vom detalia procesul esențial de antrenare, pas cu pas, folosind cadrul popular PyTorch. Indiferent dacă ești un începător curios sau un entuziast al AI-ului, acest ghid îți va oferi o înțelegere solidă a modului în care aceste sisteme inteligente prind viață.

Ce Sunt Rețelele Neurale și Cum Funcționează?

Rețelele neurale sunt modele computaționale concepute să imite structura și funcționarea creierului uman. Ele sunt alcătuite din straturi de neuroni artificiali interconectați, care procesează și transformă informațiile prin conexiuni ponderate. Fiecare neuron primește intrări, aplică transformări matematice și transmite semnale către neuronii conectați din straturile ulterioare. Procesul prin care o rețea neurală învață se numește antrenare, iar în timpul acestuia, rețeaua ajustează automat aceste ponderi de conexiune prin algoritmi precum retropropagarea (backpropagation), învățând să recunoască modele și să facă predicții precise pe baza datelor.

V-ați întrebat vreodată cum învață rețelele neurale să facă predicții sau să clasifice datele? Rețelele neurale servesc drept fundament al inteligenței artificiale, permițând mașinilor să recunoască modele și să ia decizii informate. Arhitectura de bază a unei rețele neurale include, de obicei, trei tipuri de straturi:

- Stratul de Intrare (Input Layer): Acesta este stratul unde datele inițiale sunt introduse în rețea. Fiecare neuron din acest strat corespunde, de obicei, unei caracteristici a datelor de intrare.

- Straturile Ascunse (Hidden Layers): Acestea sunt straturile intermediare unde se realizează cea mai mare parte a procesării datelor. Neuronii din aceste straturi aplică ponderi și biasuri datelor de intrare, transformându-le în reprezentări mai abstracte și mai complexe. Numărul de straturi ascunse și numărul de neuroni din fiecare strat ascuns pot varia considerabil, influențând capacitatea rețelei de a învăța modele complicate.

- Stratul de Ieșire (Output Layer): Acesta este stratul final care produce predicția sau clasificarea rețelei. Numărul de neuroni din acest strat depinde de tipul sarcinii – de exemplu, un neuron pentru regresie sau mai mulți neuroni pentru clasificare multi-clasă.

Această arhitectură permite rețelelor neurale să abordeze sarcini complexe, cum ar fi recunoașterea imaginilor și procesarea limbajului, prin dezvoltarea de reprezentări interne sofisticate ale datelor de intrare. PyTorch face construirea și antrenarea acestor rețele simplă, cu clasa sa nn.Module, care ne permite să definim arhitecturi personalizate.

Instrumente Esențiale în Antrenarea Rețelelor Neurale

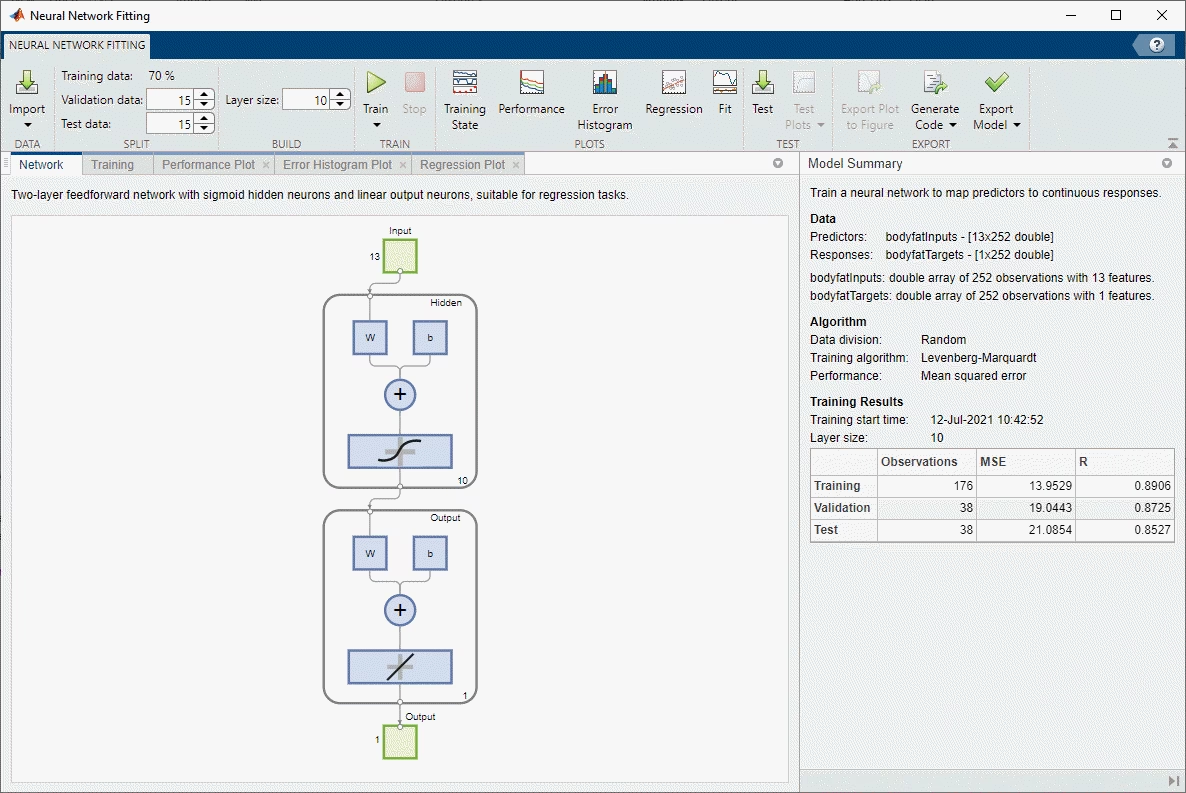

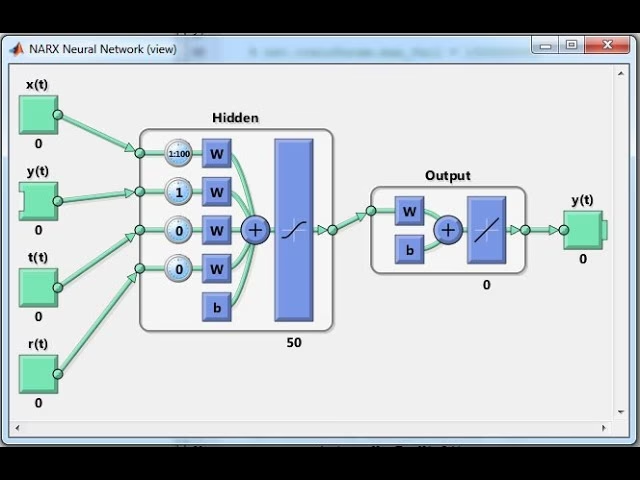

Deep Learning Toolbox în MATLAB

Deep Learning Toolbox în MATLAB oferă funcții, aplicații și blocuri Simulink pentru proiectarea, implementarea și simularea rețelelor neurale profunde. Acest toolbox oferă un cadru robust pentru a crea și utiliza multe tipuri de rețele, cum ar fi rețelele neurale convoluționale (CNNs) și transformatoarele. Cu ajutorul său, puteți vizualiza și interpreta predicțiile rețelei, verifica proprietățile rețelei și comprima rețelele prin cuantizare, proiecție sau prunning. Aplicația Deep Network Designer vă permite să proiectați, editați și analizați rețelele interactiv, să importați modele pre-antrenate și să exportați rețele către Simulink. Toolbox-ul permite interoperabilitatea cu alte cadre de învățare profundă, permițând importul de modele PyTorch, TensorFlow și ONNX pentru inferență, transfer learning, simulare și implementare. De asemenea, puteți exporta modele către TensorFlow și ONNX. Un avantaj major este capacitatea de a genera automat cod C/C++, CUDA și HDL pentru rețelele antrenate.

Funcția nntraintool în MATLAB

Funcția nntraintool deschide interfața grafică de utilizator (GUI) pentru antrenarea rețelelor neurale în MATLAB. Această funcție poate fi apelată pentru a face GUI-ul de antrenare vizibil înainte de antrenare, după antrenare dacă fereastra a fost închisă, sau pur și simplu pentru a aduce GUI-ul de antrenare în prim-plan. Pentru a accesa grafice utile suplimentare, legate de rețeaua curentă sau de ultima rețea antrenată, în timpul sau după antrenare, faceți clic pe butoanele respective din fereastra de antrenare. Acest instrument oferă o modalitate intuitivă și vizuală de a monitoriza și interacționa cu procesul de antrenare al rețelelor neurale.

Antrenarea unei Rețele Neurale cu PyTorch: Un Ghid Pas cu Pas

Pentru a construi și antrena o rețea neurală simplă, vom folosi PyTorch, un cadru de învățare automată open-source, foarte flexibil și puternic, popular pentru cercetare și dezvoltare. Următorii pași te vor ghida prin întregul proces.

1. Importarea Librăriilor Necesare

Pentru început, trebuie să importăm librăriile esențiale. PyTorch oferă tot ce avem nevoie pentru a construi rețele neurale, a defini funcțiile de pierdere și a antrena modele. Iată cum putem importa modulele necesare:

import torch import torch.nn as nn import torch.optim as optim Aici, torch este librăria de bază PyTorch. Modulul torch.nn furnizează instrumente pentru definirea și lucrul cu rețelele neurale, în timp ce torch.optim oferă diverși algoritmi de optimizare pentru antrenarea modelelor. Cu acestea la locul lor, suntem gata să definim rețeaua noastră neurală.

2. Definirea Modelului

În PyTorch, o rețea neurală este definită ca o clasă care moștenește de la nn.Module. Acest lucru ne permite să definim arhitectura rețelei și modul în care datele curg prin ea. Mai jos este implementarea unei rețele neurale simple de tip feedforward:

class SimpleNN(nn.Module): def __init__(self): super(SimpleNN, self).__init__() self.fc1 = nn.Linear(2, 5) # Strat complet conectat de la 2 la 5 neuroni self.relu = nn.ReLU() # Funcție de activare ReLU self.fc2 = nn.Linear(5, 1) # Strat complet conectat de la 5 la 1 neuron def forward(self, x): x = self.fc1(x) x = self.relu(x) x = self.fc2(x) return x În această rețea, modulul nn.Linear reprezintă un strat complet conectat (dens) într-o rețea neurală. Primul strat, fc1, transformă o intrare de dimensiune 2 într-o reprezentare de dimensiune 5. Apoi, se aplică funcția de activare ReLU (Rectified Linear Unit) pentru a introduce neliniaritate. Aceasta este esențială pentru ca rețeaua să poată învăța modele complexe, deoarece fără neliniaritate, rețeaua ar fi echivalentă cu un singur strat liniar. Stratul final, fc2, reduce apoi dimensiunea reprezentării la 1, generând ieșirea modelului.

Acum, să inițializăm acest model și să-i inspectăm structura:

model = SimpleNN() print(model) Când rulăm codul de mai sus, vom vedea arhitectura rețelei tipărită, arătând fiecare strat și configurația sa:

Model architecture: SimpleNN( (fc1): Linear(in_features=2, out_features=5, bias=True) (relu): ReLU() (fc2): Linear(in_features=5, out_features=1, bias=True) ) 3. Antrenarea Modelului

Antrenarea unei rețele neurale implică definirea unei funcții de pierdere pentru a măsura cât de bine performează modelul și a unui optimizator pentru a ajusta ponderile modelului pe baza acestei pierderi. Iată cum le configurăm:

criterion = nn.MSELoss() # Funcția de pierdere: Eroare Pătratică Medie optimizer = optim.SGD(model.parameters(), lr=0.01) # Optimizator: Descendentă de Gradient Stochastic Funcția MSELoss() (Mean Squared Error Loss) calculează diferența pătratică medie dintre valorile prezise și cele reale. Aceasta se concentrează pe erorile mai mari, deoarece ridicarea la pătrat a diferențelor le penalizează mai puternic. Această abordare încurajează modelul să prioritizeze minimizarea discrepanțelor semnificative. De exemplu, dacă ieșirea prezisă este departe de valoarea țintă, MSELoss amplifică această diferență, ghidând optimizatorul să facă ajustări semnificative ale ponderilor.

Optimizatorul SGD (Stochastic Gradient Descent) actualizează iterativ ponderile pentru a reduce eroarea, iar parametrul lr (learning rate) controlează rata de învățare, adică mărimea pasului cu care sunt ajustate ponderile la fiecare iterație. O rată de învățare prea mare poate face ca modelul să „sare” peste minimul global, în timp ce o rată prea mică poate duce la o antrenare foarte lentă.

4. Pregătirea Datelor

Să creăm câteva date fictive pentru antrenarea noastră:

inputs = torch.tensor([[1.0, 2.0], [2.0, 3.0], [3.0, 4.0]]) targets = torch.tensor([[5.0], [7.0], [9.0]]) Aici, inputs reprezintă caracteristicile de intrare, iar targets sunt valorile de ieșire corespunzătoare pe care dorim ca rețeaua să le învețe să le prezică. Aceste date simple ne vor permite să observăm comportamentul de bază al rețelei.

5. Bucla de Antrenare

Procesul de antrenare implică multiple iterații (epoci) peste setul de date. În fiecare epocă, calculăm predicțiile, calculăm pierderea, efectuăm o trecere înapoi (backward pass) pentru a calcula gradienții și actualizăm ponderile modelului. Să implementăm acest lucru:

for epoch in range(5): optimizer.zero_grad() # Resetează gradienții outputs = model(inputs) # Efectuează o trecere înainte (forward pass) loss = criterion(outputs, targets) # Calculează pierderea loss.backward() # Efectuează o trecere înapoi (backward pass) pentru a calcula gradienții optimizer.step() # Actualizează ponderile modelului print(f'Epoch [{epoch + 1}/5], Loss: {loss.item():.4f}') În timpul fiecărei epoci, modelul face predicții (outputs), calculează cât de departe sunt acestea de valorile reale (loss), calculează gradienții pentru a înțelege cum să ajusteze ponderile (loss.backward()) și, în cele din urmă, actualizează ponderile (optimizer.step()). Metoda optimizer.zero_grad() este crucială la începutul fiecărei iterații pentru a șterge gradienții acumulați din iterațiile anterioare, asigurând că actualizările ponderilor sunt bazate doar pe pierderea curentă.

Rularea acestei bucle produce o ieșire similară cu:

Epoch [1/5], Loss: 53.3861 Epoch [2/5], Loss: 48.7173 Epoch [3/5], Loss: 41.8362 Epoch [4/5], Loss: 30.5981 Epoch [5/5], Loss: 15.2334 Observați cum pierderea scade cu fiecare epocă, pe măsură ce modelul învață să facă predicții mai bune. Acest lucru indică faptul că rețeaua converge și își îmbunătățește performanța pe setul de date de antrenare.

6. Evaluarea Modelului

După antrenare, este timpul să evaluăm performanța modelului pe date noi, neobservate. Să-l testăm cu o nouă intrare:

test_data = torch.tensor([[4.0, 5.0]]) prediction = model(test_data) print(f'Prediction: {prediction.item():.4f}') Ieșirea ar putea arăta astfel:

Prediction: 10.8516 Acest rezultat indică predicția modelului pentru intrarea [4.0, 5.0]. Deși nu este perfectă, este rezonabil de aproape de valoarea așteptată de 4 + 5 + 2 = 11 (bazat pe modelul din datele de antrenare). Este important de reținut că ieșirile se vor schimba de fiecare dată când rulați codul, deoarece rețelele neurale sunt inițializate aleatoriu și utilizează metode stocastice (aleatorii) în timpul antrenării. Acest lucru subliniază natura probabilistică a învățării mașinilor și necesitatea de a rula experimente de mai multe ori pentru a obține o medie a performanței.

Arhitectura Rețelei Noastre Simple: O Privire Detaliată

Pentru a înțelege mai bine cum funcționează SimpleNN, iată o descriere detaliată a fiecărui strat:

| Strat | Tip | Intrare | Ieșire | Funcție |

|---|---|---|---|---|

fc1 | nn.Linear | 2 | 5 | Transformă datele de intrare (2 caracteristici) într-o reprezentare intermediară de 5 neuroni, aplicând ponderi și biasuri. |

relu | nn.ReLU | 5 | 5 | Introduce neliniaritate în model, convertind toate valorile negative la zero și lăsând valorile pozitive neschimbate. Esențială pentru învățarea modelelor complexe. |

fc2 | nn.Linear | 5 | 1 | Reduce reprezentarea intermediară (5 neuroni) la ieșirea finală a modelului (1 neuron), care este predicția. |

Întrebări Frecvente (FAQ)

Ce este o funcție de pierdere și de ce este importantă?

O funcție de pierdere (loss function) măsoară discrepanța dintre predicțiile modelului și valorile reale. Este crucială deoarece cuantifică „greșeala” modelului, ghidând optimizatorul să ajusteze ponderile pentru a minimiza această eroare. Fără o funcție de pierdere, nu am ști cum să îmbunătățim modelul.

Ce face un optimizator?

Un optimizator este un algoritm care ajustează ponderile și biasurile rețelei neurale pe baza gradientilor calculați de funcția de pierdere. Scopul său este de a minimiza funcția de pierdere, permițând modelului să învețe din date și să facă predicții mai precise. Exemple comune includ SGD, Adam, RMSprop.

Ce înseamnă „epocă” în contextul antrenării rețelelor neurale?

O epocă (epoch) reprezintă o trecere completă a întregului set de date de antrenare prin rețeaua neurală. În timpul unei epoci, modelul procesează toate exemplele de antrenare, calculează pierderea, actualizează ponderile și biasurile, și apoi trece la următoarea epocă. Antrenarea implică de obicei sute sau mii de epoci pentru ca modelul să învețe eficient.

De ce este necesară o funcție de activare (precum ReLU)?

Funcțiile de activare introduc neliniaritate în rețeaua neurală. Fără ele, o rețea neurală ar fi doar o serie de transformări liniare, indiferent de câte straturi ar avea, și ar putea învăța doar relații liniare între intrări și ieșiri. Neliniaritatea este esențială pentru ca rețelele să poată modela relații complexe și să învețe modele complicate din date.

De ce rezultatele predicției mele pot varia la fiecare rulare?

Rezultatele pot varia din cauza inițializării aleatorii a ponderilor rețelei neurale și a naturii stocastice a algoritmilor de optimizare (cum ar fi SGD). Fiecare rulare pornește de la un punct de plecare ușor diferit și ia pași ușor diferiți în spațiul parametrilor, ducând la rezultate finale care pot diferi marginal. Aceasta este o caracteristică normală a antrenării rețelelor neurale.

Concluzie

În acest tutorial, am parcurs pașii de construire și antrenare a unei rețele neurale simple folosind PyTorch. Am văzut cum PyTorch oferă un cadru robust pentru dezvoltarea rețelelor neurale prin clasa nn.Module, care ne permite să definim arhitecturi personalizate cu straturi de intrare, ascunse și de ieșire. Am înțeles că antrenarea unei rețele neurale implică pași cruciali: definirea unei funcții de pierdere (cum ar fi MSELoss) pentru a măsura performanța modelului, alegerea unui optimizator (cum ar fi SGD) pentru a ajusta ponderile și iterarea prin multiple epoci pentru a îmbunătăți predicțiile.

Bucla de antrenare, formată dintr-o trecere înainte pentru predicții, urmată de calcularea pierderii, o trecere înapoi pentru calcularea gradienților și actualizări ale ponderilor prin optimizator, reprezintă inima procesului de învățare. Aceste componente lucrează împreună pentru a reduce progresiv eroarea modelului. Evaluarea modelului după antrenare, prin testarea cu date neobservate, este vitală pentru a confirma dacă rețeaua a învățat modelele subiacente, mai degrabă decât să fi memorat pur și simplu datele de antrenare.

Am reținut că, deși acest tutorial demonstrează concepte de bază, rețelele neurale pot fi făcute mult mai complexe pentru a aborda probleme sofisticate din lumea reală. Înțelegerea acestor fundamente este primul pas către explorarea vastului și dinamicului domeniu al inteligenței artificiale și învățării profunde. Capacitatea de a construi și antrena aceste modele deschide noi orizonturi pentru inovație și soluții tehnologice avansate.

Dacă vrei să descoperi și alte articole similare cu Dezvăluind Secretele Rețelelor Neurale: Un Ghid Complet, poți vizita categoria Fitness.