11/11/2023

Antrenarea modelelor de inteligență artificială este un proces complex, iar unul dintre cele mai importante aspecte este asigurarea că modelul final este cel mai performant și generalizabil posibil. De multe ori, un model nu atinge performanța sa maximă imediat, ci trece printr-o serie de epoci de antrenament, iar performanța sa pe datele de validare poate fluctua. În acest context, devine esențial să știm cum să identificăm și să salvăm versiunea optimă a modelului, prevenind în același timp probleme precum supraînvățarea. Acest articol va explora concepte cheie precum dimensiunea lotului (batch_size), va detalia tehnicile de oprire timpurie (EarlyStopping) și de salvare a modelului (ModelCheckpoint) în TensorFlow, oferind o abordare practică pentru a-ți optimiza procesul de antrenament.

Înainte de a ne scufunda în strategiile de salvare, este crucial să înțelegem un concept fundamental în antrenament: dimensiunea lotului (batch_size). Atunci când antrenăm o rețea neuronală, nu introducem de obicei toate datele de antrenament simultan. În schimb, datele sunt împărțite în subgrupuri, sau loturi. Dimensiunea lotului se referă la numărul de exemple de antrenament procesate înainte ca parametrii modelului să fie actualizați. De exemplu, dacă ai 1000 de imagini și un batch_size de 32, modelul va procesa 32 de imagini, va calcula gradientul și va actualiza greutățile, apoi va trece la următorul lot de 32 de imagini și așa mai departe, până când toate cele 1000 de imagini au fost procesate (o epocă). Alegerea dimensiunii lotului are implicații semnificative. Un batch_size mic (de exemplu, 1 sau 4) poate duce la o convergență mai lentă, dar poate ajuta modelul să iasă din minimele locale și să generalizeze mai bine, deoarece actualizările sunt mai zgomotoase. Pe de altă parte, un batch_size mare (de exemplu, 128 sau 256) accelerează antrenamentul, deoarece mai multe date sunt procesate în paralel, dar poate duce la o generalizare mai slabă și la o convergență către minime locale mai puțin optime. De asemenea, dimensiunea lotului influențează direct cerințele de memorie ale GPU-ului; loturile mai mari necesită mai multă memorie. Echilibrul perfect depinde de dataset, arhitectura modelului și resursele disponibile.

De Ce Este Crucial Să Salvezi Cel Mai Bun Model?

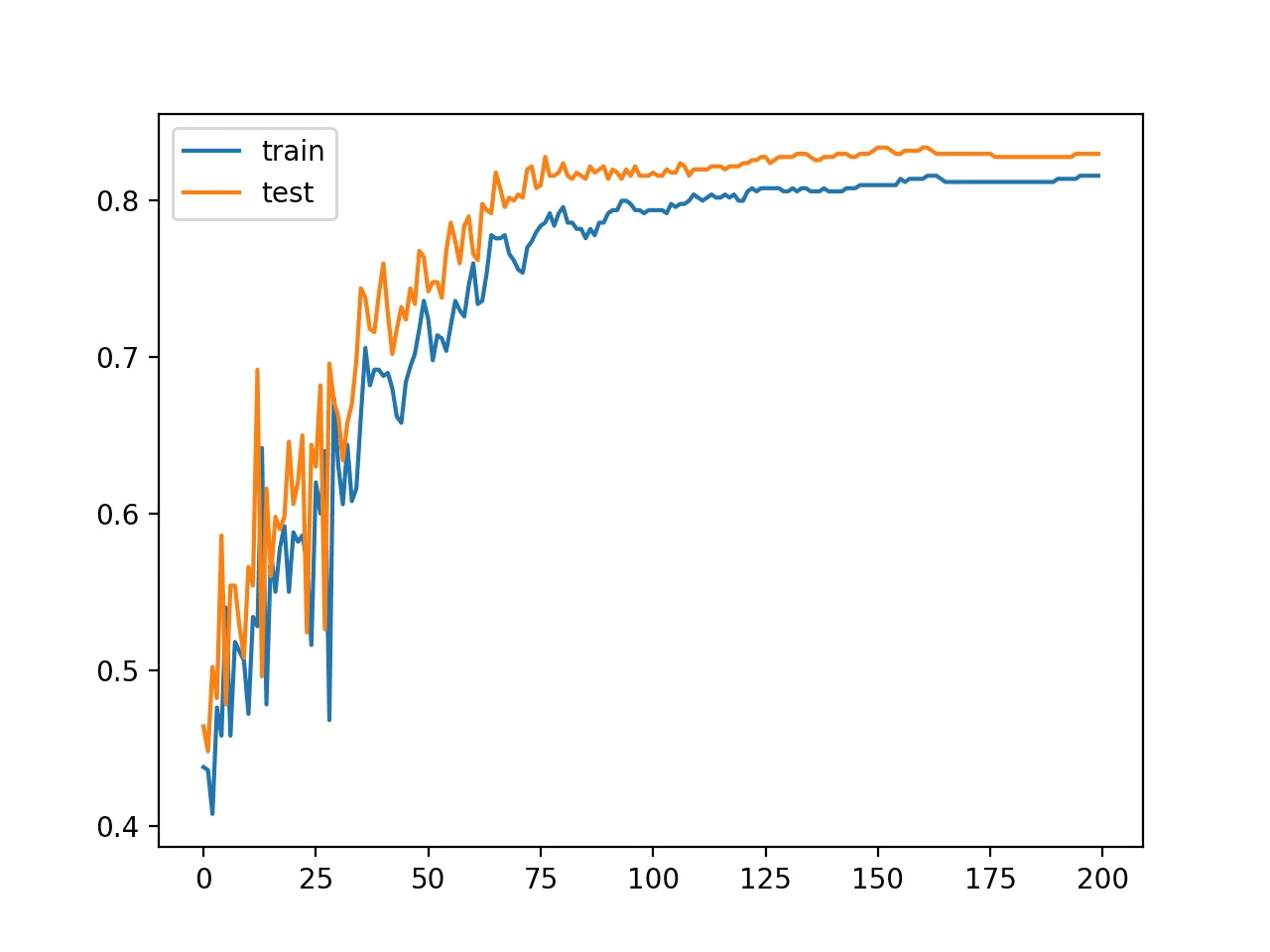

Antrenarea unui model de învățare automată implică adesea rularea a sute sau chiar mii de epoci. Pe măsură ce antrenamentul progresează, performanța modelului pe datele de antrenament se îmbunătățește constant. Cu toate acestea, performanța pe datele de validare, care sunt o estimare mai bună a modului în care modelul se va comporta pe date nevăzute, poate începe să stagneze sau chiar să se deterioreze după un anumit punct. Această deteriorare este un semn clar de supraînvățare (overfitting), un fenomen în care modelul învață zgomotul și detaliile specifice datelor de antrenament, pierzându-și capacitatea de a generaliza la date noi. Salvarea celui mai bun model, bazată pe performanța pe setul de validare, este esențială pentru:

- Prevenirea Supraînvățării: Prin salvarea modelului înainte de a începe să supraînvețe, ne asigurăm că avem o versiune care generalizează cel mai bine.

- Reluarea Antrenamentului: Dacă antrenamentul este întrerupt (din cauza unei erori sau a unei pene de curent), poți relua de la ultimul punct salvat, economisind timp și resurse.

- Implementare și Replicare: Odată antrenat, modelul poate fi încărcat și utilizat pentru predicții sau pentru a reproduce rezultatele antrenamentului.

Oprirea Timpurie (EarlyStopping): Un Scut Împotriva Supraînvățării

EarlyStopping este o tehnică fundamentală pentru a preveni supraînvățarea. Ideea este simplă: dacă performanța modelului pe setul de validare nu se îmbunătățește pentru un anumit număr de epoci consecutive, antrenamentul ar trebui oprit. Acest lucru nu doar economisește timp de calcul, ci și asigură că modelul nu supraînvață. În TensorFlow/Keras, EarlyStopping este implementat ca un callback, o funcție care este apelată la anumite puncte în timpul antrenamentului.

Parametrii cheie ai callback-ului EarlyStopping sunt:

monitor: Metrica pe care o urmărim pentru a determina performanța modelului. De obicei, este'val_loss'(pierderea pe setul de validare) sau'val_accuracy'(acuratețea pe setul de validare).patience: Numărul de epoci fără îmbunătățire după care antrenamentul va fi oprit. De exemplu, dacăpatience=3, antrenamentul se va opri dacă pierderea de validare nu scade timp de 3 epoci consecutive.mode: Specifică dacă metrica monitorizată ar trebui să fie 'min' (pentru pierdere, căutăm minimul) sau 'max' (pentru acuratețe, căutăm maximul). Valoarea implicită este determinată automat.min_delta: O îmbunătățire minimă absolută în metrica monitorizată pentru a fi considerată o îmbunătățire reală. Orice îmbunătățire mai mică decâtmin_deltaeste ignorată.restore_best_weights: Dacă esteTrue, greutățile modelului vor fi restaurate la cele din epoca cu cea mai bună performanță pe metrica monitorizată. Aceasta este o caracteristică extrem de utilă, asigurându-te că ai întotdeauna cel mai bun model.

Un exemplu conceptual de utilizare ar arăta astfel:

from tensorflow.keras.callbacks import EarlyStoppingearly_stopping = EarlyStopping(monitor='val_loss', patience=10, restore_best_weights=True)model.fit(x_train, y_train, epochs=100, validation_data=(x_test, y_test), callbacks=[early_stopping])

În acest caz, antrenamentul se va opri dacă val_loss nu scade timp de 10 epoci, iar modelul va fi setat la greutățile din epoca în care val_loss a fost minimă.

ModelCheckpoint: Salvarea Automată a Celor Mai Bune Versiuni

În timp ce EarlyStopping oprește antrenamentul la momentul potrivit, ModelCheckpoint este callback-ul care se ocupă de salvarea propriu-zisă a modelului în timpul antrenamentului. Acesta permite salvarea periodică a modelului sau, mai important, salvarea modelului doar atunci când s-a înregistrat o îmbunătățire a performanței pe setul de validare.

Parametrii cheie ai callback-ului ModelCheckpoint sunt:

filepath: Calea către fișierul în care va fi salvat modelul. Poate include formate Python pentru a încorpora numărul epocii sau valoarea metricii monitorizate (ex:'model_best_{epoch:02d}_{val_loss:.2f}.h5').monitor: Metrica pe care o urmărim pentru a decide când să salvăm. Similar cu EarlyStopping, de obicei'val_loss'sau'val_accuracy'.save_best_only: Dacă esteTrue, modelul va fi salvat doar dacă performanța pe metrica monitorizată este mai bună decât cea anterioară. Acesta este parametrul cheie pentru a salva doar 'cel mai bun' model.mode: Similar cu EarlyStopping ('min' sau 'max').save_weights_only: Dacă esteTrue, salvează doar greutățile modelului (model.save_weights()). Dacă esteFalse, salvează întregul model (arhitectură, optimizator, greutăți, stare optimizator, etc.,model.save()). Salvarea întregului model este mai convenabilă pentru reîncărcare.verbose: Nivelul de detaliu al mesajelor afișate. 0 pentru silențios, 1 pentru mesaje de informare.

Un exemplu conceptual de utilizare ar arăta astfel:

from tensorflow.keras.callbacks import ModelCheckpointcheckpoint_filepath = 'cel_mai_bun_model.h5'model_checkpoint_callback = ModelCheckpoint( filepath=checkpoint_filepath, monitor='val_loss', mode='min', save_best_only=True)model.fit(x_train, y_train, epochs=100, validation_data=(x_test, y_test), callbacks=[model_checkpoint_callback])

După antrenament, fișierul 'cel_mai_bun_model.h5' va conține versiunea modelului care a înregistrat cea mai mică pierdere de validare pe parcursul antrenamentului.

Combinarea EarlyStopping și ModelCheckpoint pentru Antrenament Robust

Cea mai bună strategie este să folosești ambele callback-uri împreună. EarlyStopping se asigură că antrenamentul se oprește la momentul optim, prevenind supraînvățarea excesivă și economisind resurse. ModelCheckpoint, cu save_best_only=True, se asigură că, indiferent când se oprește antrenamentul, ai salvat deja cea mai bună versiune a modelului. Dacă folosești restore_best_weights=True în EarlyStopping, modelul tău va avea deja cele mai bune greutăți la sfârșitul antrenamentului, dar ModelCheckpoint oferă o salvare persistentă a acestora.

Iată cum ar arăta un setup tipic:

from tensorflow.keras.callbacks import EarlyStopping, ModelCheckpointcheckpoint_filepath = 'modele/model_cel_mai_bun.h5'early_stopping_callback = EarlyStopping(monitor='val_loss', patience=15, restore_best_weights=True)model_checkpoint_callback = ModelCheckpoint( filepath=checkpoint_filepath, monitor='val_loss', mode='min', save_best_only=True, verbose=1)callbacks_list = [early_stopping_callback, model_checkpoint_callback]model.fit(x_train, y_train, epochs=200, validation_data=(x_test, y_test), callbacks=callbacks_list)

În acest scenariu, antrenamentul va rula până la 200 de epoci sau până când val_loss nu se îmbunătățește timp de 15 epoci consecutive. De fiecare dată când val_loss atinge o nouă valoare minimă, ModelCheckpoint va suprascrie fișierul model_cel_mai_bun.h5 cu noua versiune optimă a modelului. La finalul antrenamentului, modelul din memorie va avea greutățile cele mai bune (datorită restore_best_weights=True), iar pe disc vei avea, de asemenea, o copie a acestuia.

Considerații Suplimentare și Sfaturi Practice

Alegerea metricii de monitorizat este crucială. Pentru probleme de clasificare, 'val_accuracy' poate fi o alegere bună, în timp ce pentru regresie, 'val_loss' este adesea preferată. Asigură-te că mode ('min' sau 'max') corespunde metricii alese. De asemenea, experimentează cu valoarea patience pentru EarlyStopping; o valoare prea mică poate opri antrenamentul prea devreme, în timp ce una prea mare poate permite o supraînvățare minoră. Nu uita să creezi directorul specificat în filepath pentru ModelCheckpoint, dacă acesta nu există deja.

Tabel Comparativ: EarlyStopping vs. ModelCheckpoint

| Caracteristică | EarlyStopping | ModelCheckpoint |

|---|---|---|

| Scop Principal | Previne supraînvățarea, oprește antrenamentul | Salvează modelul (sau greutățile) |

| Acțiune | Întrerupe procesul de fit | Scrie fișiere pe disc |

Necesită save_best_only? | Nu (are restore_best_weights) | Da, pentru a salva doar 'cel mai bun' |

| Restaurare Greutăți | Poate restaura greutățile cele mai bune în modelul din memorie | Salvează o copie persistentă a greutăților/modelului |

| Impact Asupra Antrenamentului | Controlează durata antrenamentului | Asigură persistența modelului optim |

| Utilizare Tipică | Împreună, pentru un antrenament eficient și robust | Împreună, pentru un antrenament eficient și robust |

Întrebări Frecvente

Ce se întâmplă dacă nu salvez cel mai bun model?

Dacă nu salvezi cel mai bun model, riști să pierzi progresul antrenamentului. Modelul final pe care îl ai în memorie la sfârșitul epocilor poate fi supraînvățat, adică performanța sa pe date noi va fi slabă. Fără o salvare a celei mai bune versiuni bazate pe validare, va trebui să reîncepi antrenamentul pentru a încerca să obții o versiune mai bună, ceea ce este ineficient și consumator de timp.

Pot folosi ModelCheckpoint fără EarlyStopping?

Da, poți folosi ModelCheckpoint independent. În acest caz, antrenamentul va rula până la numărul maxim de epoci specificat, iar ModelCheckpoint va salva modelul conform configurației sale (de exemplu, la fiecare epocă, sau doar când se înregistrează o nouă performanță maximă). Cu toate acestea, combinarea ambelor este recomandată pentru că EarlyStopping te ajută să oprești antrenamentul la momentul optim, economisind resurse și prevenind supraînvățarea excesivă.

Ce metrică ar trebui să monitorizez (monitor)?

Alegerea metricii depinde de problema ta. Pentru probleme de clasificare, 'val_accuracy' este o alegere comună. Pentru probleme de regresie, 'val_loss' (pierderea de validare) este de obicei preferată, deoarece o pierdere mai mică indică o performanță mai bună. Este esențial să monitorizezi o metrică pe setul de *validare*, nu pe cel de antrenament, pentru a evalua capacitatea de generalizare a modelului.

Cât de des ar trebui să salvez modelul?

Dacă folosești save_best_only=True în ModelCheckpoint, modelul va fi salvat doar atunci când se înregistrează o îmbunătățire a performanței. Aceasta este cea mai eficientă metodă. Dacă dorești să salvezi modelul periodic, indiferent de performanță (de exemplu, pentru a avea puncte de restaurare), poți seta save_best_only=False și save_freq='epoch' (pentru a salva la fiecare epocă) sau un număr specific de pași.

Care este diferența dintre salvarea întregului model și doar a greutăților?

Când salvezi întregul model (save_weights_only=False), salvezi arhitectura modelului, configurația optimizatorului, starea optimizatorului și greutățile. Aceasta este opțiunea cea mai convenabilă, deoarece poți reîncărca modelul cu o singură linie de cod (tf.keras.models.load_model(filepath)) și este gata de utilizare sau de continuarea antrenamentului. Când salvezi doar greutățile (save_weights_only=True), salvezi doar valorile numerice ale parametrilor modelului. Pentru a le reîncărca, trebuie să recreezi mai întâi arhitectura modelului și apoi să încarci greutățile (model.load_weights(filepath)). Aceasta este utilă dacă vrei să folosești greutățile într-o arhitectură ușor modificată sau dacă vrei să economisești spațiu pe disc (fișierele cu greutăți sunt de obicei mai mici).

În concluzie, stăpânirea tehnicilor de EarlyStopping și ModelCheckpoint este fundamentală pentru orice practician de învățare automată care lucrează cu TensorFlow. Aceste callback-uri nu doar că te ajută să obții cel mai bun model posibil, prevenind supraînvățarea, dar și optimizează procesul de antrenament, economisind timp și resurse computaționale. Integrându-le în fluxul tău de lucru, vei putea antrena modele mai robuste și mai performante, gata să facă față provocărilor din lumea reală.

Dacă vrei să descoperi și alte articole similare cu Salvarea Celui Mai Bun Model în TensorFlow, poți vizita categoria Fitness.