15/08/2022

În era digitală actuală, inteligența artificială (AI) nu mai este doar un concept futurist, ci o realitate care ne transformă viețile zi de zi. De la asistenți vocali la sisteme de recomandare, AI-ul este pretutindeni. Dar ce urmează? Viitorul AI-ului este definit de capacitatea sa de a înțelege și interacționa cu lumea într-un mod mai holistic, combinând informații din diverse surse. Aici intervin Modelele Viziune-Limbaj (VLM), o inovație revoluționară care promite să redefinească modul în care mașinile percep și procesează informația. Suntem mândri să vă prezentăm un curs complet și, mai important, gratuit, conceput pentru a vă ghida în această lume fascinantă a VLM-urilor, oferindu-vă cunoștințe practice și abilități esențiale pentru a construi următoarea generație de aplicații AI.

- Ce Sunt Modelele Viziune-Limbaj (VLM)?

- De Ce Sunt VLM-urile Esențiale în AI-ul Modern?

- Modulul 1: Stăpânirea CLIP și Încărcăturile Multimodale

- Modulul 2: Qwen2.5-VL – Dincolo de Subtitrare

- Cine Ar Trebui Să Urmeze Acest Curs?

- Comparație: CLIP vs. Qwen2.5-VL

- Întrebări Frecvente (FAQ)

- O Poartă Către Viitorul Aplicațiilor AI

Ce Sunt Modelele Viziune-Limbaj (VLM)?

Imaginați-vă un sistem AI care nu doar vede o imagine, ci o și înțelege, o descrie și poate răspunde la întrebări despre ea, totul într-un mod coerent și natural, similar cu inteligența umană. Acesta este scopul Modelelor Viziune-Limbaj (VLM). Spre deosebire de modelele tradiționale de viziune computerizată care se concentrează exclusiv pe imagini sau de modelele de limbaj natural (NLP) care procesează doar text, VLM-urile sunt concepute să integreze și să proceseze simultan informații din ambele modalități: vizuală și lingvistică. Ele învață relațiile profunde dintre imagini și descrierile lor textuale, permițându-le să efectueze sarcini complexe care necesită înțelegerea ambelor lumi.

Această capacitate de a lega viziunea de limbaj deschide noi orizonturi pentru AI. Gândiți-vă la un robot care poate înțelege instrucțiuni verbale pentru a naviga într-un mediu necunoscut și a identifica obiecte specifice, sau la o aplicație care poate genera automat descrieri detaliate pentru imagini, ajutând persoanele cu deficiențe de vedere. Potențialul este imens și abia începem să-i zgâriem suprafața.

De Ce Sunt VLM-urile Esențiale în AI-ul Modern?

Relevanța VLM-urilor în peisajul AI-ului modern nu poate fi subestimată. Trăim într-o lume bogată în date multimodale – imagini cu descrieri, videoclipuri cu subtitrări, documente cu diagrame. Modelele tradiționale se luptă să proceseze eficient această complexitate. VLM-urile, pe de altă parte, sunt construite special pentru a excela în acest mediu.

- Înțelegere Contextuală Superioară: Prin combinarea viziunii cu limbajul, VLM-urile pot înțelege contextul complet al unei situații, nu doar elemente izolate.

- Flexibilitate și Adaptabilitate: Ele pot fi adaptate pentru o gamă largă de sarcini, de la clasificare la generare, fără a necesita re-antrenare extinsă pentru fiecare nouă aplicație.

- Aplicații Inovatoare: De la sisteme de securitate inteligente care detectează anomalii bazate pe descrieri, la asistenți personali care pot răspunde la întrebări despre conținutul vizual, VLM-urile alimentează inovații care erau de neconceput acum câțiva ani.

- Eficiență în Învățare: Prin învățarea din relațiile dintre modalități, VLM-urile pot adesea învăța mai eficient și cu mai puține date etichetate, în special în scenarii de tip zero-shot.

Acest curs vă va echipa cu instrumentele și cunoștințele necesare pentru a naviga și a contribui la această frontieră a inteligenței artificiale.

Modulul 1: Stăpânirea CLIP și Încărcăturile Multimodale

Prima etapă a călătoriei noastre în lumea VLM-urilor începe cu o scufundare profundă în CLIP (Contrastive Language-Image Pre-training). CLIP, dezvoltat de OpenAI, a revoluționat modul în care înțelegem relația dintre imagini și text. Spre deosebire de alte modele care necesită etichetări explicite pentru fiecare categorie, CLIP învață să asocieze imagini cu descrierile lor textuale într-un spațiu de încorporare multimodal.

Ce Sunt Încărcăturile Multimodale?

Imaginați-vă un spațiu matematic unde obiectele similare (fie că sunt imagini sau descrieri textuale) sunt plasate aproape una de alta. Încărcăturile multimodale ale CLIP realizează exact acest lucru: ele transformă atât imaginile, cât și textele în vectori numerici (încărcături) în același spațiu. Această aliniere permite modelului să înțeleagă semantica comună dintre o imagine și o descriere, chiar dacă nu a văzut niciodată o pereche exactă în timpul antrenamentului.

Clasificarea Zero-Shot cu CLIP

Unul dintre cele mai impresionante aspecte ale CLIP este capacitatea sa de clasificare zero-shot. Aceasta înseamnă că modelul poate clasifica imagini în categorii pe care nu le-a întâlnit niciodată în timpul antrenamentului. Cum funcționează? Pur și simplu îi oferiți o listă de categorii sub formă de text (de exemplu, "o pisică", "un câine", "o mașină"), iar CLIP va compara încorporarea imaginii cu încorporările textuale ale acestor categorii, identificând cea mai apropiată potrivire semantică. Această flexibilitate elimină necesitatea re-antrenării modelului pentru fiecare nouă sarcină de clasificare, economisind timp și resurse considerabile.

În acest modul, veți învăța să:

- Înțelegeți arhitectura și principiile de funcționare ale CLIP.

- Generați încărcături multimodale pentru imagini și text.

- Implementați clasificarea zero-shot pentru diverse aplicații.

- Explorați capabilitățile de căutare semantică bazate pe CLIP.

Modulul 2: Qwen2.5-VL – Dincolo de Subtitrare

După ce ați stăpânit fundamentele cu CLIP, vom avansa la Qwen2.5-VL, un model VLM de ultimă generație, mult mai complex și capabil de sarcini avansate, cum ar fi subtitrarea imaginilor și detecția de obiecte zero-shot. Qwen2.5-VL, ca și alte modele mari de limbaj multimodal, este construit pe arhitecturi transformer și este antrenat pe seturi masive de date, permițându-i să genereze descrieri textuale coerente și detaliate pentru imagini și să identifice obiecte fără a fi antrenat explicit pentru acele obiecte.

Subtitrarea Imaginii (Image Captioning)

Subtitrarea imaginii este procesul de generare automată a unei descrieri textuale a conținutului unei imagini. Qwen2.5-VL excelează în această sarcină, producând subtitrări care nu doar identifică obiecte, ci și descriu relațiile dintre ele, acțiunile care se desfășoară și contextul general. Această capacitate este crucială pentru accesibilitate, indexare de conținut și interacțiuni om-mașină mai naturale.

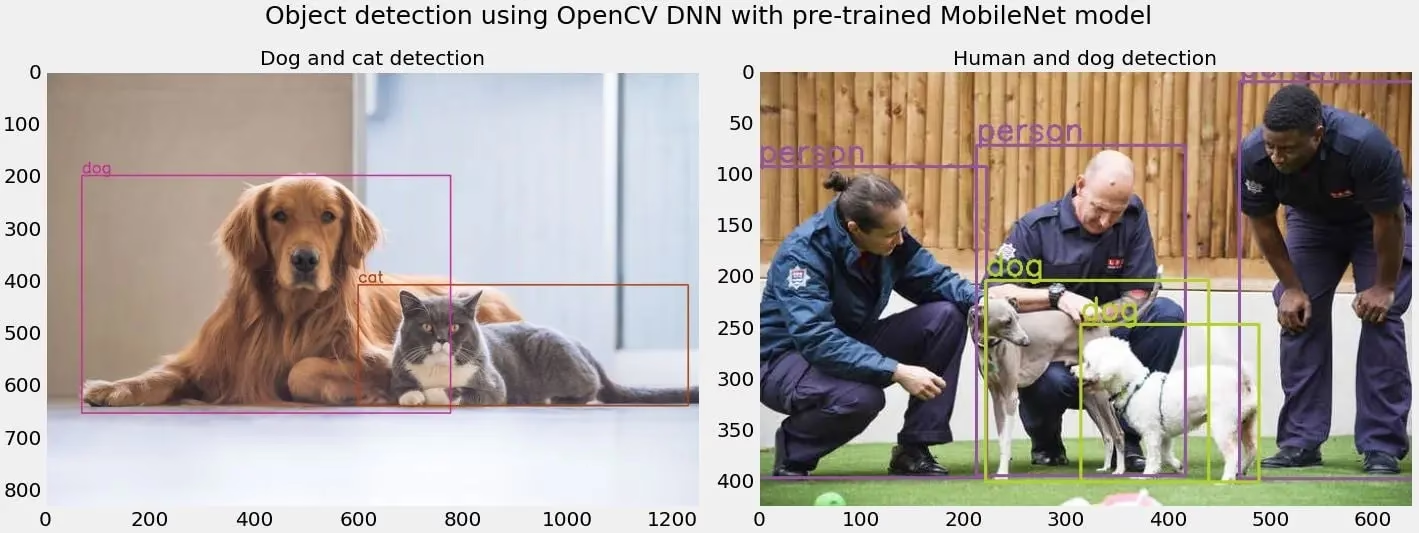

Detecția de Obiecte Zero-Shot

În timp ce detecția tradițională de obiecte necesită antrenarea modelului cu mii de exemple etichetate pentru fiecare obiect pe care doriți să-l detectați, Qwen2.5-VL aduce conceptul de zero-shot și în detecția de obiecte. Aceasta înseamnă că puteți cere modelului să detecteze obiecte pe care nu le-a văzut niciodată în timpul antrenamentului, pur și simplu oferind o descriere textuală a obiectului. Această flexibilitate este un schimbător de joc pentru aplicații care necesită adaptabilitate rapidă la noi concepte.

În acest modul, veți învăța să:

- Utilizați Qwen2.5-VL pentru a genera subtitrări precise și contextuale pentru imagini.

- Implementați detecția de obiecte zero-shot folosind capacitățile avansate ale Qwen2.5-VL.

- Explorați potențialul Qwen2.5-VL în aplicații complexe, cum ar fi răspunsul vizual la întrebări (VQA) și interacțiunile multimodale.

- Înțelegeți limitările și provocările actuale ale modelelor VLM de mari dimensiuni.

Cine Ar Trebui Să Urmeze Acest Curs?

Acest curs este conceput pentru o gamă largă de entuziaști și profesioniști în AI, indiferent de nivelul de experiență. Fie că sunteți un student curios care își dorește să exploreze frontierele AI-ului, un dezvoltator care caută să-și extindă setul de abilități, un cercetător interesat de cele mai recente inovații în viziunea computerizată și NLP, sau pur și simplu o persoană pasionată de tehnologie și viitorul AI, acest curs vă va oferi o bază solidă și expertiză practică.

Nu este necesară o experiență prealabilă extinsă în AI, dar o înțelegere de bază a programării (preferabil Python) și a conceptelor fundamentale de învățare automată va fi benefică. Cu toate acestea, materialul este structurat pentru a fi accesibil, cu explicații clare și exemple practice.

Comparație: CLIP vs. Qwen2.5-VL

Pentru a înțelege mai bine rolul fiecărui model în ecosistemul VLM, iată o scurtă comparație:

| Caracteristică | CLIP (Contrastive Language-Image Pre-training) | Qwen2.5-VL |

|---|---|---|

| Obiectiv Principal | Crearea de încărcături multimodale aliniate (text-imagine) | Generare text coerent, înțelegere vizuală avansată |

| Aplicații Cheie | Clasificare zero-shot, căutare semantică, filtrare conținut | Subtitrare imagini, detecție zero-shot de obiecte, răspuns vizual la întrebări (VQA), dialog vizual |

| Complexitate | Medie spre înaltă, focalizat pe aliniere | Foarte înaltă, model generativ de mari dimensiuni |

| Abordare | Învățare contrastivă, reprezentări dense | Arhitectură transformer, învățare autoregresivă |

| Dificultate de Implementare (bază) | Accesibilă pentru începători cu Python | Necesită o înțelegere mai profundă a modelelor mari |

Întrebări Frecvente (FAQ)

Am adunat cele mai comune întrebări pentru a vă oferi claritate:

1. Cursul este cu adevărat gratuit?

Absolut! Acest curs este oferit complet gratuit. Scopul nostru este să democratizăm accesul la educația de înaltă calitate în domeniul AI și să echipăm cât mai mulți oameni cu abilitățile necesare pentru a naviga în peisajul tehnologic în continuă evoluție.

2. Am nevoie de experiență prealabilă în AI sau programare?

O înțelegere de bază a programării (în special Python) este recomandată, deoarece veți lucra cu cod. Nu este necesară o experiență profundă în AI, însă, deoarece conceptele sunt explicate de la zero. Cursul este structurat pentru a fi accesibil atât începătorilor, cât și celor cu experiență.

3. Ce resurse sau software-uri voi avea nevoie?

Veți avea nevoie de un computer cu acces la internet și, ideal, un mediu de dezvoltare Python (cum ar fi Anaconda sau un mediu virtual). Pentru anumite exerciții practice, ar putea fi util accesul la o unitate GPU, însă multe operațiuni pot fi efectuate și pe CPU sau prin servicii cloud gratuite (precum Google Colab).

4. Cât timp îmi va lua să finalizez cursul?

Durata cursului depinde de ritmul individual de învățare. Este conceput pentru a fi flexibil, permițându-vă să învățați în propriul ritm. Estimăm că o parcurgere completă, incluzând exercițiile practice, ar putea dura între 20 și 40 de ore, distribuite pe parcursul câtorva săptămâni, în funcție de timpul pe care îl puteți dedica zilnic.

5. Ce oportunități de carieră deschide acest curs?

Stăpânirea VLM-urilor vă deschide porți către roluri de inginer AI, cercetător în viziune computerizată, inginer de învățare automată, dezvoltator de aplicații AI, și multe altele. Companiile din diverse sectoare, de la tehnologie la sănătate și retail, caută experți în AI multimodal pentru a construi soluții inovatoare. Acest curs vă oferă un avantaj competitiv pe piața muncii în continuă expansiune a AI-ului.

O Poartă Către Viitorul Aplicațiilor AI

Acest curs gratuit despre Modelele Viziune-Limbaj nu este doar o colecție de lecții; este o invitație de a vă alătura unei comunități de inovatori și de a contribui la modelarea viitorului AI. Prin stăpânirea conceptelor și implementărilor practice ale CLIP și Qwen2.5-VL, veți dobândi o înțelegere profundă a modului în care viziunea computerizată și procesarea limbajului natural pot fi integrate pentru a crea sisteme inteligente cu adevărat revoluționare.

Nu ratați această oportunitate unică de a vă echipa cu abilitățile necesare pentru a construi următoarea generație de aplicații AI. Indiferent de nivelul vostru actual de cunoștințe, acest curs vă va propulsa în prima linie a inovației AI. Pregătiți-vă să explorați, să experimentați și să inovați. Viitorul AI-ului este multimodal, iar acest curs este ghidul vostru către el.

Dacă vrei să descoperi și alte articole similare cu Descoperă Viitorul AI: Curs VLM Gratuit, poți vizita categoria Fitness.